Trí tuệ nhân tạo đang đóng vai trò quan trọng trong cách mạng trí tuệ nhân tạo. Hiện nay, các doanh nghiệp đang dấn thân mạnh mẽ vào thế giới của trí tuệ nhân tạo, và NVIDIA AI Enterprise là công cụ giúp họ nhanh chóng áp dụng trí tuệ nhân tạo vào công việc và giảm thiểu khó khăn khi tiếp cận với công nghệ này.

Với hơn 50 khung, mô hình đào tạo sẵn và công cụ phát triển, NVIDIA AI Enterprise là công cụ đáng giá cho các công ty muốn đạt được lợi thế cạnh tranh trong lĩnh vực trí tuệ nhân tạo.

Thêm vào đó, tin vui là AT&T Corp. và NVIDIA đã hợp tác để chuyển đổi hoạt động của AT&T và tăng cường tính bền vững bằng cách sử dụng AI do NVIDIA cung cấp. Các công ty sử dụng bộ phần mềm NVIDIA AI Enterprise, bao gồm Bộ tăng tốc NVIDIA RAPIDS cho Apache Spark để cải thiện quá trình xử lý dữ liệu. Đây là một ví dụ về cách trí tuệ nhân tạo đang thay đổi các doanh nghiệp và mang lại nhiều lợi ích.

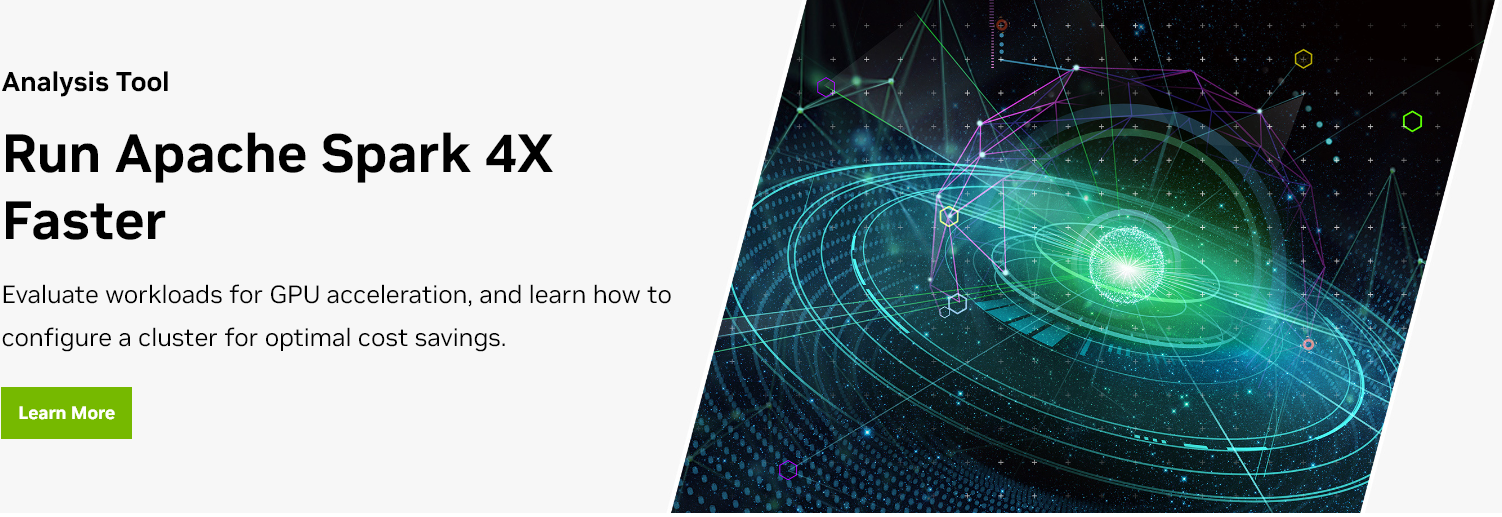

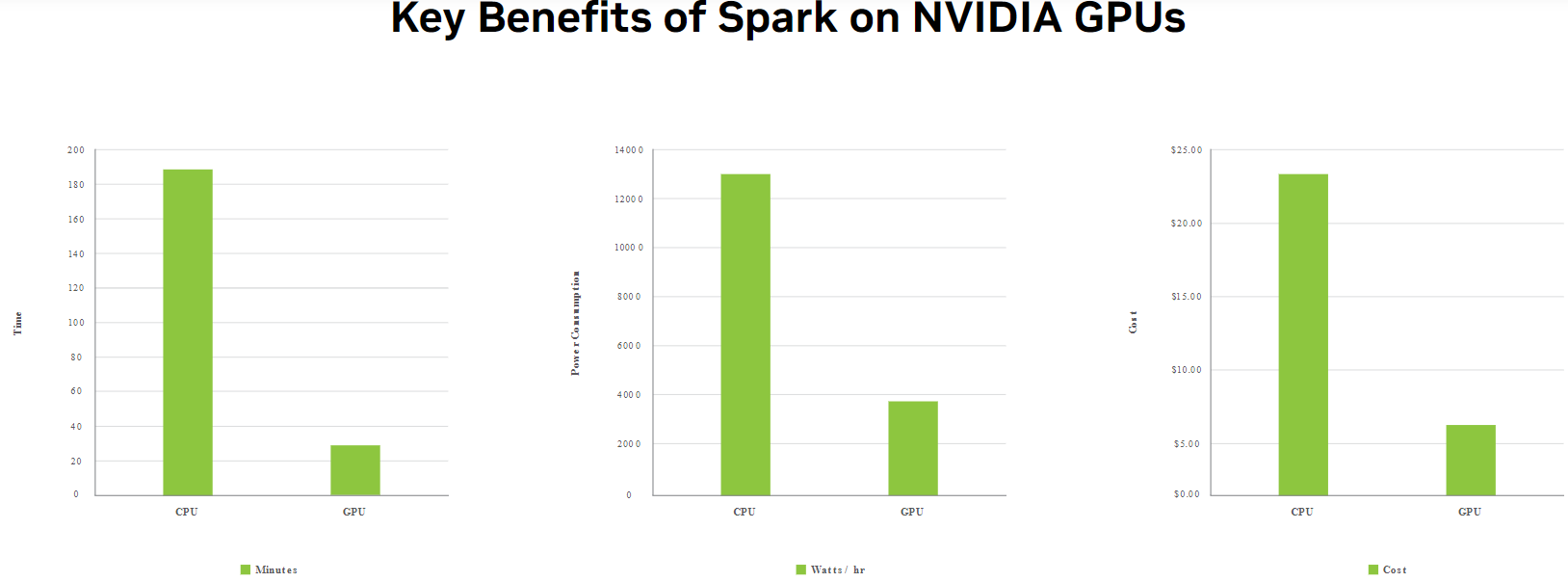

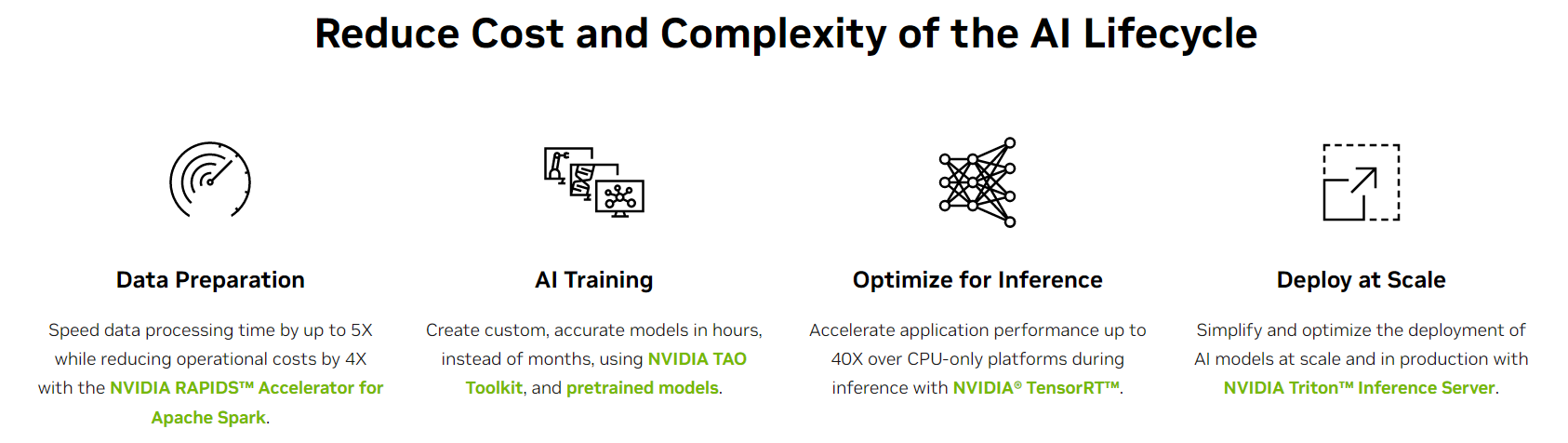

NVIDIA AI Enterprise vừa mới được cập nhật với nhiều tính năng và công cụ mới, bao gồm Trình tăng tốc RAPIDS cho Apache Spark, NVIDIA AI Workflows cho các đề xuất sản phẩm cá nhân hóa và tối ưu hóa tuyến đường, khả năng mở rộng trên đám mây và hỗ trợ cho kiến trúc GPU mới nhất của NVIDIA, Ada Lovelace. Trong đó, Trình tăng tốc RAPIDS cho Apache Spark được đánh giá cao vì cung cấp tốc độ xử lý dữ liệu nhanh gấp 5 lần, rất quan trọng khi các tổ chức tích lũy dữ liệu ngày càng lớn và yêu cầu thời gian xử lý nhanh hơn.

Các tính năng mới của NVIDIA AI Enterprise chứng tỏ việc sử dụng trí tuệ nhân tạo đang phát triển nhanh chóng và NVIDIA là nhà cung cấp hàng đầu hỗ trợ các tổ chức khai thác tiềm năng của công nghệ này. Với việc kết hợp Trình tăng tốc RAPIDS cho Apache Spark, NVIDIA AI Enterprise 3.1 đã đạt được bước đột phá đáng kể, giúp tăng tốc xử lý dữ liệu lên tới 5 lần và giảm chi phí cơ sở hạ tầng lên tới 75% mà không cần thay đổi mã, đáp ứng nhu cầu của các nhà khoa học và kỹ sư dữ liệu.

NVIDIA AI Enterprise đã được cập nhật với nhiều tính năng mới để tối ưu hóa hiệu suất triển khai Spark trên các nền tảng được chứng nhận như Amazon EMR, Google Cloud Dataproc và Databricks trên Azure và AWS. Đặc biệt, NVIDIA AI Workflows hiện đang cung cấp hai ví dụ tham khảo sẵn để xây dựng các giải pháp AI trên đám mây, bao gồm quy trình AI Dự đoán mục tiếp theo và quy trình AI Tối ưu hóa lộ trình, giúp khách hàng cải thiện khả năng giữ chân khách hàng và bán thêm, cũng như giảm chi phí và thời gian giao hàng.

Để đáp ứng nhu cầu truy cập, NVIDIA AI Enterprise đã được phát hành trên Google Cloud Marketplace và sẽ sớm có trên AWS và Microsoft Azure Marketplaces. Khách hàng có thể bắt đầu sử dụng và truy cập bộ phần mềm đầy đủ chỉ trong vài phút. NVIDIA AI Enterprise cung cấp khung và công cụ AI để xây dựng các đường ống khoa học dữ liệu và các ứng dụng AI với sự hỗ trợ cấp doanh nghiệp từ NVIDIA. Nó cũng được chứng nhận để chạy trên các nền tảng đám mây như Google Cloud, AWS, Azure và Oracle Cloud cho những khách hàng có giấy phép của riêng họ.

NVIDIA AI Enterprise 3.1 đã được nâng cấp để hỗ trợ các môi trường lưu trữ bộ chứa Kubernetes, bao gồm Amazon Elastic Kubernetes Service (Amazon EKS) và Google Kubernetes Engine (GKE). Người dùng có thể sử dụng phiên bản GPU tích hợp để triển khai tác vụ AI phân tán trên đám mây với phần mềm AI được tối ưu hóa, hỗ trợ đầy đủ và triển khai hiệu quả.

Phiên bản mới nhất của NVIDIA AI Enterprise cung cấp hỗ trợ cho các GPU kiến trúc NVIDIA Ada Lovelace mới nhất, bao gồm NVIDIA L4, NVIDIA L40 và NVIDIA RTX 6000 Ada Generation, để tăng cường khối lượng công việc suy luận và tính toán AI cường độ cao. Ngoài ra, phiên bản này còn cải tiến cơ sở hạ tầng đám mây lai, bao gồm hỗ trợ cho các cấu hình không đồng nhất cho khối lượng công việc hỗn hợp và chứng chỉ MLOps với ClearML.

Bản phát hành Bản cập nhật 1 của VMware vSphere 8 đã được chứng nhận và hỗ trợ để cho phép triển khai NVIDIA NVSwitch. Người dùng có thể trải nghiệm thực tế khi chạy NVIDIA AI Enterprise trên GPU NVIDIA L4 thông qua NVIDIA LaunchPad.

→ Bắt đầu với NVIDIA AI Enterprise: Đăng ký NVIDIA LaunchPad để có trải nghiệm AI trong một môi trường tính toán tăng tốc riêng biệt bao gồm các bài thực hành. Trải nghiệm các quy trình làm việc AI của NVIDIA cho đề xuất sản phẩm, tối ưu hóa tuyến đường, AI nói, an ninh mạng và nhiều hơn nữa.

Bài viết liên quan

- NVIDIA NGC‑ready Low‑latency Edge AI: Giải pháp cho Retail, Manufacturing và Smart Cities

- So sánh sức mạnh của máy tính AI DGX Spark với các card GPU máy trạm chuyên nghiệp của NVIDIA

- Từ Orin đến Thor: Bước nhảy vọt kiến trúc của NVIDIA JetPack 7.0 và tương lai của robot hình người

- Tại sao gọi NVIDIA DGX Spark là Siêu máy tính AI cá nhân?

- Cơ chế quản lý bộ nhớ trên các nền tảng phần cứng nhất quán – Hardware-coherent

- Kiến trúc NVIDIA Blackwell với GB200 NVL72: Định nghĩa lại điện toán AI cấp độ Exascale