Sự xuất hiện của Generative AI Những tiến bộ và đổi mới trong lĩnh vực Trí tuệ nhân tạo đã được nêu bật bởi hiệu suất khó giải thích của Generative AI (AI tạo sinh), một mô hình mang tính cách mạng có khả năng thể hiện sự sáng tạo ấn tượng và không thể…

Author: Anh Huy

Tổng quan về Computer Vision – Thị giác máy tính

Computer Vision (CV) hay Thị giác máy tính – mô tả một lĩnh vực cho phép các thiết bị thu thập, xử lý, hiểu và phân tích hình ảnh và video kỹ thuật số cũng như trích xuất thông tin hữu ích. Computer Vision là gì? Computer Vision có mục tiêu chính đầu tiên là hiểu nội…

NVIDIA DRIVE: Giải pháp chuyên biệt dành cho phát triển phương tiện tự hành

Phần mềm chính là thứ có thể biến một phương tiện thông thường thành một cỗ máy thông minh. Bộ phát triển phần mềm mở NVIDIA DRIVE cung cấp cho các developer tất cả các khối xây dựng (building blocks) và các lớp thuật toán cần thiết cho việc phát triển hệ thống xe tự lái…

Sự khác biệt giữa bộ nhớ GDDR và DDR là gì?

GDDR và DDR có nghĩa là gì? DDR là viết tắt của Double Data Rate và GDDR là viết tắt của Graphics Double Data Rate. Nhưng cần nói rõ, kiến trúc DDR và GDDR không có chung tiêu chuẩn như tốc độ, băng thông,… Chúng ta có thể phân loại chúng thành những công nghệ hoàn…

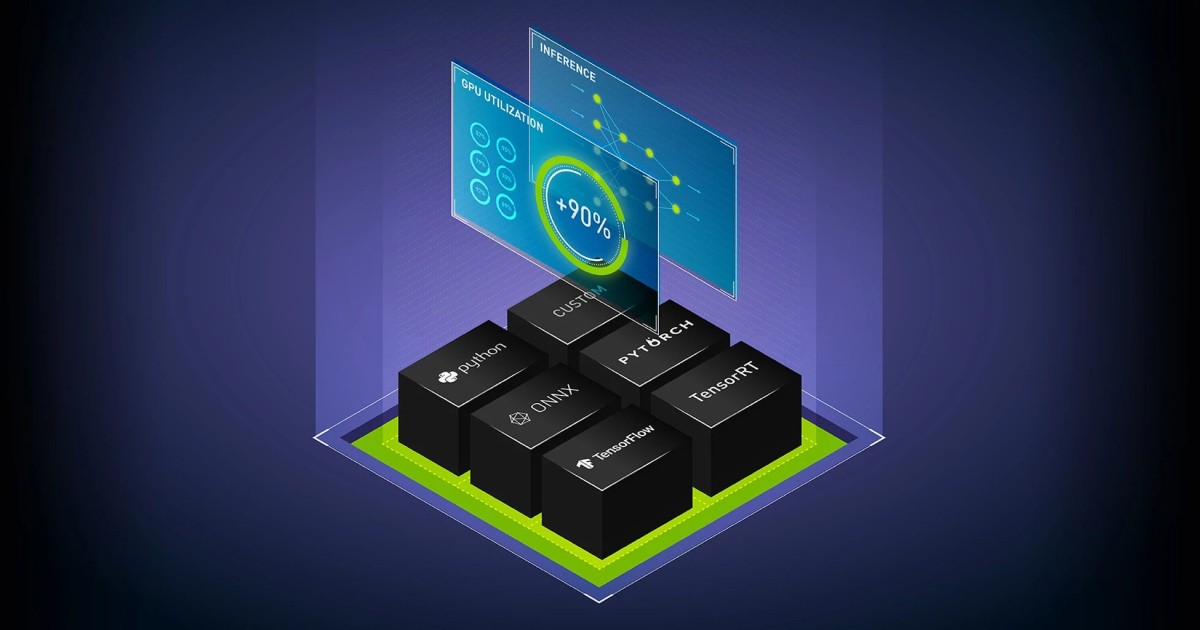

NVIDIA Triton: Triển khai, chạy và tăng quy mô AI cho mọi ứng dụng

Suy luận dành cho mọi tác vụ AI Chạy suy luận trên các mô hình Học máy (ML) hoặc Học sâu (DL) đã được đào tạo từ bất kỳ framework nào trên bất kỳ bộ xử lý nào – GPU, CPU hay các loại khác – với NVIDIA Triton Inference Server. Là một phần của nền tảng…

NVIDIA CEO Jensen Huang sẽ chủ trì AI Summit tại Tel Aviv

Nhà sáng lập kiêm Giám đốc điều hành của NVIDIA – Jensen Huang sẽ nêu bật những điểm mới nhất về Generative AI và Điện toán đám mây (Cloud Computing) trong sự kiện NVIDIA AI Summit tại Tel Aviv, Israel từ ngày 15 đến ngày 16 tháng 10 này. Hội nghị kéo dài hai ngày dự kiến…

NVIDIA Morpheus: Nền tảng phát triển ứng dụng Cybersecurity AI

Khi các mối đe dọa an ninh mạng tiếp tục leo thang và đa dạng hóa, các tổ chức phải tìm kiếm những cách mới để giải quyết chúng. An ninh mạng (cybersecurity) là một vấn đề về dữ liệu. Việc thu thập và phân tích tất cả dữ liệu trên mạng theo thời gian thực…

“Siêu chip” NVIDIA Grace Hopper thống lĩnh các bài test benchmark MLPerf về suy luận

Siêu chip NVIDIA GH200, GPU H100, L4 và các module Jetson Orin cho thấy hiệu suất vượt trội khi chạy AI ở môi trường sản xuất, từ đám mây đến rìa mạng. Trong lần kiểm tra đầu tiên trên điểm benchmark chuyên ngành MLPerf, NVIDIA GH200 Grace Hopper Superchip đã chạy tất cả các bài test suy…

Khởi động hành trình AI của bạn với NVIDIA và Dell Technologies

Trí tuệ nhân tạo (AI) đã trở thành một công cụ ngày càng mang tính nền tảng cho các doanh nghiệp muốn đạt được lợi thế cạnh tranh. Tuy nhiên, xây dựng hạ tầng AI từ đầu có thể là một nhiệm vụ khó khăn, đặc biệt đối với những công ty mới khởi đầu. Đó…

Google Cloud và NVIDIA mở rộng quan hệ đối tác để nâng cao dịch vụ, phần mềm, điện toán AI

Công nghệ Generative AI của NVIDIA được Google DeepMind và các nhóm nghiên cứu của Google sử dụng hiện đã được tối ưu hóa và có sẵn cho khách hàng của Google Cloud trên toàn thế giới Tại hội nghị Google Cloud Next – Google Cloud và NVIDIA đã công bố cơ sở hạ tầng…