NVIDIA DGX™ Spark mang phát triển AI doanh nghiệp lên máy tính để bàn. Chạy các mô hình lớn, thử nghiệm quy trình làm việc sẵn sàng sản xuất và mở rộng quy mô vào cơ sở hạ tầng NVIDIA DGX™ bằng một hệ thống.

Một dạng máy tính để bàn được xây dựng cho AI quy mô doanh nghiệp

Khi các mô hình AI tiếp tục mở rộng vượt quá 100 tỷ tham số, việc phát triển cục bộ trở nên khó khăn hơn khi sử dụng các máy trạm chuẩn hoặc máy ảo dựa trên đám mây. Các nhà phát triển, nhà nghiên cứu và kỹ sư ML cần một cách để chạy các mô hình lớn, kiểm tra hiệu suất và lặp lại nhanh chóng mà không cần cam kết ngay lập tức với cơ sở hạ tầng quy mô lớn.

NVIDIA DGX™ Spark (trước đây là NVIDIA Project DIGITS) được tạo ra cho giai đoạn phát triển này. Nó đưa các công nghệ cốt lõi được sử dụng trong NVIDIA DGX BasePOD™ và NVIDIA DGX SuperPOD™ vào một hệ số dạng nhỏ gọn, với tối đa 1.000 AI TOPS tính toán và 128 GB bộ nhớ hợp nhất mạch lạc. Nó chạy trên cùng một kiến trúc Grace Blackwell được sử dụng trong các hệ thống tiên tiến nhất của NVIDIA như NVIDIA DGX GB200 NVL và hỗ trợ toàn bộ ngăn xếp phần mềm NVIDIA AI, cung cấp cho các nhà phát triển quyền truy cập vào cùng các công cụ, quy trình làm việc và môi trường chứa được sử dụng trong sản xuất.

Bài viết này phác thảo năm lợi thế ít được biết đến của NVIDIA DGX Spark khiến nó trở thành một hệ thống GPU nhỏ gọn hơn. Mỗi tính năng đều hỗ trợ khả năng mở rộng dài hạn, giảm ma sát phát triển ban đầu và cung cấp giá trị kỹ thuật vượt xa những gì hầu hết các máy trạm có thể cung cấp.

1. NVIDIA DGX Spark chạy trên Grace, một CPU dựa trên Arm được sử dụng trong các hệ thống DGX thế hệ tiếp theo

Siêu chip NVIDIA GB10

Siêu chip NVIDIA GB10

Một nền tảng thực tế để tạo mẫu trên Arm

NVIDIA DGX Spark giới thiệu một sự thay đổi trong cách các nhà phát triển tương tác với kiến trúc hệ thống. Thay vì dựa vào bộ xử lý x86, NVIDIA DGX Spark được cung cấp năng lượng bởi NVIDIA Grace™ CPU Superchip, một bộ xử lý Arm 20 lõi được liên kết trực tiếp với Blackwell GPU bằng NVLink®-C2C. Cả CPU và GPU đều chia sẻ quyền truy cập vào một nhóm bộ nhớ thống nhất 128 GB mạch lạc, cải thiện hiệu quả cho các quy trình làm việc AI liên quan đến tiền xử lý, suy luận và trao đổi dữ liệu thường xuyên giữa các thành phần tính toán.

Thiết kế này là nền tảng cho các hệ thống Grace Blackwell ở quy mô lớn hơn. NVIDIA DGX Spark cung cấp cho các nhà phát triển một cách dễ tiếp cận để bắt đầu xây dựng và thử nghiệm khối lượng công việc tận dụng các tính năng này. Ví dụ, các tác vụ tốn nhiều bộ nhớ như định dạng nhắc nhở, xử lý mã thông báo hoặc đường ống dữ liệu đa phương thức có thể chạy hoàn toàn trong không gian bộ nhớ dùng chung này mà không phải tốn chi phí di chuyển dữ liệu qua các giao diện.

Truy cập sớm vào các tiêu chuẩn cơ sở hạ tầng sản xuất

Với các hệ thống như NVIDIA DGX B200 và NVIDIA DGX GB300 BasePOD và DGX SuperPOD sắp ra mắt chuyển sang kiến trúc dựa trên Grace, NVIDIA DGX Spark hoạt động như một nền tảng thử nghiệm rào cản thấp để điều chỉnh khả năng tương thích và hiệu suất. Nó cho phép các nhà phát triển xác thực khối lượng công việc AI trên Arm trước khi đưa ra quyết định về cơ sở hạ tầng lớn hơn. Điều này đặc biệt hữu ích cho các nhóm chuẩn bị mô hình và đường ống để triển khai cuối cùng trong các trung tâm dữ liệu mật độ cao, nơi hiệu quả năng lượng và kiến trúc bộ nhớ sẽ tác động đến chiến lược mở rộng quy mô.

Các nhà phát triển cũng có thể sử dụng NVIDIA DGX Spark để đánh giá hành vi phần mềm trên nền tảng Arm trong điều kiện tải thực tế. Từ khả năng tương thích thư viện đến điều chỉnh hiệu suất, NVIDIA DGX Spark cung cấp cho các nhóm kỹ thuật một cách để chuẩn bị cho nơi cơ sở hạ tầng NVIDIA hướng đến mà không cần cam kết phần cứng cấp rack ngay từ đầu.

Tương thích với các công cụ phát triển chung

Mặc dù kiến trúc hệ thống khác nhau, NVIDIA DGX Spark hỗ trợ nhiều công cụ chuẩn. Các khuôn khổ chính như PyTorch và TensorFlow được hỗ trợ đầy đủ và nhiều quy trình làm việc được chứa trong NGC chạy trên Arm với ít hoặc không cần sửa đổi. Các công cụ khoa học dữ liệu như RAPIDS và Dask cũng chạy gốc, cho phép các nhóm kiểm tra xử lý dữ liệu, kỹ thuật tính năng và quy trình đánh giá trong môi trường quen thuộc.

Một số phụ thuộc cấp thấp hoặc bản dựng tùy chỉnh vẫn có thể yêu cầu cập nhật để tương thích hoàn toàn, đặc biệt nếu mã của bạn dựa trên các thư viện dành riêng cho kiến trúc hoặc điều chỉnh hiệu suất. NVIDIA DGX Spark cung cấp cho các nhà phát triển khả năng xác định và giải quyết những khoảng trống này sớm, bằng cách sử dụng cùng một kiến trúc sẽ cung cấp năng lượng cho cơ sở hạ tầng thế hệ tiếp theo của NVIDIA.

2. Bạn có thể chạy mô hình 200 tỷ tham số tại chỗ với quyền kiểm soát dữ liệu đầy đủ

Hỗ trợ suy luận cho các mô hình lên đến 200 tỷ tham số

NVIDIA DGX Spark cung cấp cho các nhà phát triển khả năng chạy suy luận trên một số mô hình AI lớn nhất có sẵn công khai bằng phần cứng cục bộ. Với 128 GB bộ nhớ hợp nhất mạch lạc và hỗ trợ FP4 với tính thưa thớt, hệ thống có thể tải và thực thi các mô hình lên đến 200 tỷ tham số. Điều này bao gồm các mô hình như LLaMA 2, DeepSeek-V2 và Mistral , cùng với các mô hình nền tảng nội bộ được xây dựng cho các ứng dụng riêng tư.

Chạy suy luận cục bộ cho phép các nhóm đánh giá hiệu suất, đo độ trễ và kiểm tra hành vi nhắc nhở mà không cần phân bổ các phiên bản GPU bên ngoài. Nó cũng tạo không gian cho thử nghiệm sâu hơn, chẳng hạn như so sánh các chiến lược lượng tử hóa hoặc quan sát sự thay đổi đầu ra trên các trọng số tinh chỉnh khác nhau.

Phát triển an toàn với dữ liệu được lưu trữ tại chỗ

Đối với nhiều tổ chức, việc gửi dữ liệu lên đám mây sẽ gây ra rủi ro hoặc vi phạm chính sách nội bộ. NVIDIA DGX Spark giúp lưu trữ các tập dữ liệu nhạy cảm trong môi trường cục bộ, an toàn trong khi vẫn thử nghiệm và điều chỉnh các mô hình có dung lượng cao. Các nhà phát triển có thể làm việc với dữ liệu sản xuất trong quá trình xác thực mô hình, ghi nhật ký kết quả trực tiếp vào hệ thống cục bộ và kiểm tra đầu ra mà không cần di chuyển tài sản vào nền tảng của bên thứ ba.

Cách tiếp cận này đặc biệt phù hợp với các nhóm trong ngành có yêu cầu tuân thủ hoặc quy trình đánh giá nội bộ như chăm sóc sức khỏe, chính phủ, tài chính hoặc quốc phòng. NVIDIA DGX Spark hỗ trợ chu kỳ phát triển đầy đủ, trong đó mọi dữ liệu đều nằm trong tầm kiểm soát của bạn.

Được xây dựng cho quá trình chuyển đổi sang cơ sở hạ tầng AI tại chỗ

Đối với các nhóm chuẩn bị triển khai các hệ thống quy mô lớn hơn, NVIDIA DGX Spark hoạt động như một nền tảng xây dựng ban đầu phù hợp với hành vi của các hệ thống trung tâm dữ liệu của NVIDIA. Các ứng dụng và container được phát triển trên NVIDIA DGX Spark sẽ tương thích với DGX BasePOD, SuperPOD hoặc cơ sở hạ tầng dựa trên Grace Blackwell khác.

NTC hỗ trợ quy trình này bằng cách lập kế hoạch triển khai, dịch vụ tích hợp và hỗ trợ xác thực để giúp khách hàng chuyển từ giai đoạn phát triển ban đầu sang triển khai tại chỗ hoàn chỉnh khi đã sẵn sàng.

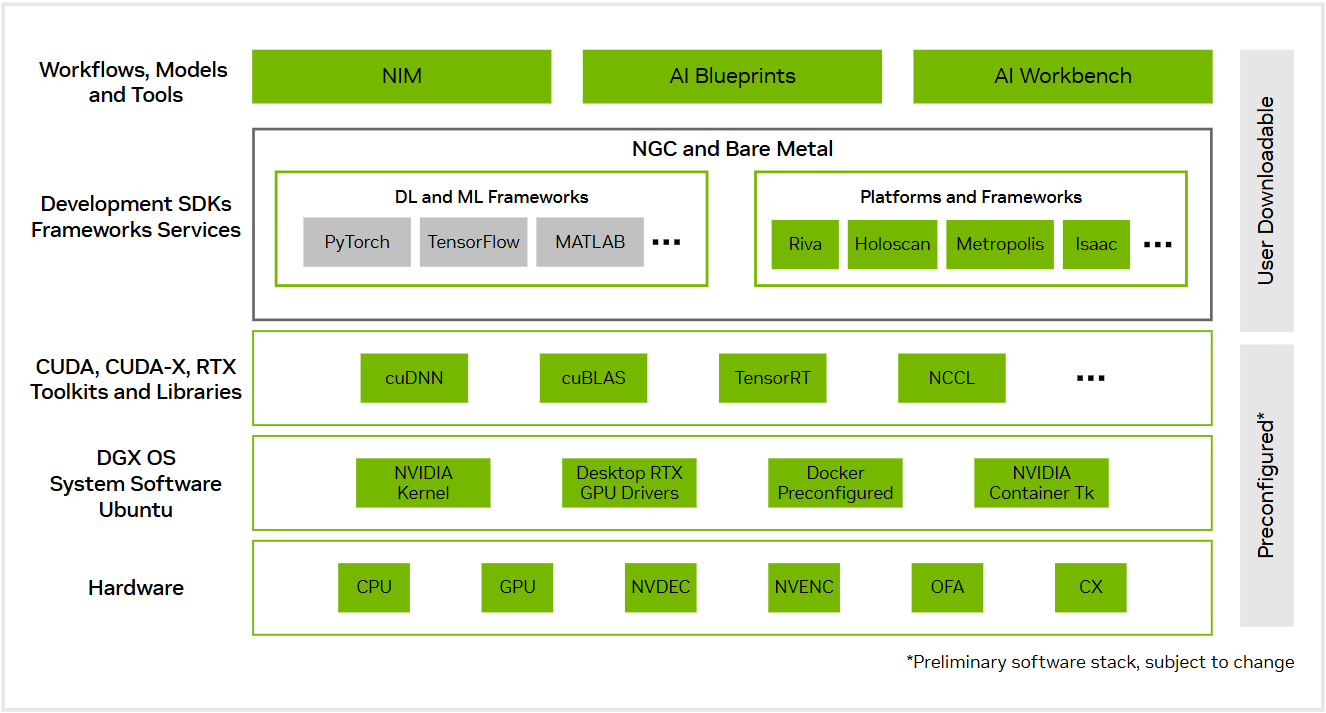

3. Toàn bộ phần mềm NVIDIA AI chạy gốc trên NVIDIA DGX Spark

Được tải sẵn các công cụ AI cấp doanh nghiệp

NVIDIA DGX Spark được cung cấp cùng một ngăn xếp phần mềm được sử dụng trên toàn bộ nền tảng DGX, bao gồm DGX BasePOD và SuperPOD. Bao gồm NVIDIA DGX OS, một hệ điều hành dựa trên Linux tùy chỉnh được xây dựng cho khối lượng công việc AI, cùng với thời gian chạy container, trình điều khiển GPU và thư viện hỗ trợ phát triển khoa học dữ liệu và học sâu. Hệ thống đã sẵn sàng để sử dụng, cho phép các nhà phát triển bắt đầu chạy container và khởi chạy công việc mà không cần cấu hình bổ sung.

Các công cụ đi kèm hỗ trợ suy luận, đào tạo, đóng gói mô hình và quy trình làm việc MLOps. Điều này cung cấp tính liên tục trong suốt vòng đời phát triển, từ thử nghiệm mô hình ban đầu đến các container sẵn sàng triển khai. Môi trường phần mềm được NVIDIA duy trì và cập nhật thường xuyên, giúp giảm ma sát trong quá trình thiết lập và phát triển lâu dài.

Các Container được Tối ưu hóa và các Mô hình được Đào tạo Trước từ NGC

NVIDIA DGX Spark cung cấp quyền truy cập vào danh mục NVIDIA NGC, nơi các nhà phát triển có thể kéo các container được tối ưu hóa cho các khuôn khổ như PyTorch, TensorFlow và JAX. Nó cũng bao gồm các mô hình được đào tạo trước và các đường ống mẫu được điều chỉnh hiệu suất cho phần cứng NVIDIA. Các tài nguyên này giúp các nhóm di chuyển nhanh hơn bằng cách cung cấp các điểm khởi đầu được xác thực cho LLM, mô hình tầm nhìn, hệ thống đề xuất và các khối lượng công việc phổ biến khác.

Vì các tài sản này được liên kết với cơ sở hạ tầng quy mô sản xuất, các nhà phát triển có thể tự tin rằng các mô hình được xây dựng hoặc thử nghiệm trên NVIDIA DGX Spark sẽ mở rộng quy mô một cách sạch sẽ khi chuyển sang các hệ thống đa nút. Điều này cũng làm giảm nỗ lực cần thiết để cấu trúc lại các ứng dụng hoặc làm lại các tệp cấu hình khi chuyển sang sản xuất.

Hỗ trợ cho Microservices và Công cụ quy trình làm việc

NVIDIA DGX Spark hỗ trợ các quy trình phát triển AI hiện đại, bao gồm triển khai microservice và phục vụ mô hình thông qua NVIDIA Inference Microservices. Các nhà phát triển có thể chứa các mô hình bằng các công cụ như Triton, triển khai REST hoặc điểm cuối gRPC để suy luận cục bộ và sử dụng cùng định nghĩa đường ống mà họ sẽ sử dụng trên DGX BasePOD.

Các công cụ như NVIDIA AI Workbench và Blueprints cũng được hỗ trợ, giúp chuẩn hóa thử nghiệm và cải thiện khả năng tái tạo. Đối với các nhóm xây dựng các công cụ hoặc đường ống nội bộ bằng cách sử dụng phối hợp container, NVIDIA DGX Spark cung cấp một nền tảng nhất quán và được ghi chép đầy đủ để phát triển và thử nghiệm các khối lượng công việc đó trước khi triển khai lớn hơn.

4. Hai đơn vị NVIDIA DGX Spark có thể được nhóm lại để hỗ trợ các mô hình 405 tỷ tham số

Hai NVIDIA DGX Spark được kết nối qua ConnectX 7 SmartNIC

Thu nhỏ gọn cho các kích thước mô hình đòi hỏi khắt khe

NVIDIA DGX Spark có thể được liên kết trực tiếp với một đơn vị thứ hai bằng cách sử dụng ConnectX-7 SmartNIC tích hợp, cho phép các nhà phát triển mở rộng kích thước mô hình và dung lượng bộ nhớ vượt quá khả năng xử lý của một hệ thống duy nhất. Trong cấu hình hai nút này, Spark hỗ trợ chạy các mô hình với tối đa 405 tỷ tham số bằng cách sử dụng FP4 với tính thưa thớt. Điều này rất có giá trị đối với các nhóm làm việc với LLM tiên tiến hoặc hỗn hợp các mô hình chuyên gia, trong đó kích thước mô hình có thể ảnh hưởng đến chất lượng đầu ra, độ sâu suy luận và kiểm soát cấp mã thông báo.

Chạy suy luận ở quy mô này cho phép các nhà phát triển kiểm tra hiệu suất, độ chính xác và độ trễ hoạt động như thế nào trên số lượng tham số lớn mà không cần dựa vào cơ sở hạ tầng bên ngoài. Nó cũng cung cấp một môi trường thực tế hơn để đánh giá các quyết định về kiến trúc mô hình, hành vi của cửa sổ mã thông báo và sự đánh đổi bộ nhớ. Đối với các nhóm có kế hoạch chuyển sang triển khai phân tán lớn hơn, việc nhóm hai hệ thống NVIDIA DGX Spark cung cấp một điểm khởi đầu thực tế để đánh giá các đặc điểm hiệu suất liên quan đến quy mô trong quy trình phát triển cục bộ.

5. NVIDIA DGX Spark là một phần của nền tảng DGX và có thể mở rộng thành các triển khai lớn hơn

NVIDIA DGX Family

Được thiết kế để tương thích trên các nền tảng DGX

NVIDIA DGX Spark là một phần của cùng một kiến trúc nền tảng cung cấp năng lượng cho NVIDIA® DGX Station™, DGX BasePOD và DGX SuperPOD. Nó chạy Grace Blackwell GB10 Superchip và sử dụng cùng một mô hình bộ nhớ, kết nối và phần mềm hệ thống như các đối tác lớn hơn của nó. Điều này làm cho Spark trở thành một hệ thống cấp độ phát triển phù hợp tự nhiên với cơ sở hạ tầng DGX rộng hơn. Đối với các nhóm xây dựng khối lượng công việc được chứa trong container, đường ống đào tạo hoặc dịch vụ suy luận, Spark cung cấp một điểm vào không yêu cầu phải điều chỉnh hoặc làm lại mã để triển khai trong tương lai.

Phù hợp với Công cụ Doanh nghiệp và Quy trình làm việc Đám mây

Vì NVIDIA DGX Spark chạy toàn bộ ngăn xếp phần mềm NVIDIA DGX, nên nó hỗ trợ khối lượng công việc được xây dựng bằng NVIDIA AI Enterprise, cũng như các môi trường được kết nối với DGX Cloud. Điều này bao gồm các công cụ để phối hợp, phục vụ mô hình và giám sát, cùng với hỗ trợ cho phát triển nhiều người dùng an toàn. Các nhóm có thể xác thực quy trình làm việc của họ cục bộ trên Spark, sau đó triển khai các vùng chứa đó trong hệ thống tại chỗ nhiều nút hoặc cấu hình kết hợp bao gồm các tài nguyên DGX Cloud. Hành vi vẫn nhất quán trên các nền tảng, giúp giảm thời gian phát triển và giúp các nhóm duy trì các điểm chuẩn hiệu suất đáng tin cậy.

Có thể mở rộng với sự hỗ trợ từ đối tác NPN của NVIDIA

Đối với các tổ chức đang có kế hoạch chuyển từ nguyên mẫu cục bộ sang cơ sở hạ tầng AI cấp sản xuất, Nhất Tiến Chung (đối tác NPN cấp độ Elite của NVIDIA) cung cấp các dịch vụ cần thiết để mở rộng quy mô một cách tự tin. Điều này bao gồm hướng dẫn về triển khai DGX BasePOD quy mô giá đỡ, tích hợp DGX Cloud và xây dựng SuperPOD làm mát bằng chất lỏng tùy chỉnh. NTC giúp đảm bảo rằng công việc bắt đầu trên NVIDIA DGX Spark vẫn có thể chuyển giao trực tiếp cho các hệ thống sẽ đưa công việc đó vào sản xuất. Cho dù bước tiếp theo là bổ sung năng lực tính toán hay di chuyển khối lượng công việc vào một triển khai lớn hơn, NTC đều hỗ trợ toàn bộ vòng đời của cơ sở hạ tầng AI dựa trên DGX.

Được xây dựng để mở rộng quy mô cùng bạn

NVIDIA DGX Spark cung cấp một cách thực tế để đưa phát triển mô hình lớn vào trong nhà mà không cần chi phí cho cơ sở hạ tầng rack-scale đầy đủ. Với sự hỗ trợ cho kiến trúc dựa trên Arm, suy luận tham số 200B+ và ngăn xếp phần mềm NVIDIA AI đầy đủ, nó cung cấp một con đường rõ ràng từ tạo mẫu đến sản xuất.

Bài viết liên quan

- NVIDIA RTX PRO 4500 Blackwell Server Edition: Bước nhảy vọt từ thế hệ L4 cho hạ tầng AI suy luận hiệu năng cao

- NVIDIA NGC‑ready Low‑latency Edge AI: Giải pháp cho Retail, Manufacturing và Smart Cities

- So sánh sức mạnh của máy tính AI DGX Spark với các card GPU máy trạm chuyên nghiệp của NVIDIA

- Từ Orin đến Thor: Bước nhảy vọt kiến trúc của NVIDIA JetPack 7.0 và tương lai của robot hình người

- Tại sao gọi NVIDIA DGX Spark là Siêu máy tính AI cá nhân?

- Cơ chế quản lý bộ nhớ trên các nền tảng phần cứng nhất quán – Hardware-coherent