NVIDIA Grace là CPU trung tâm dữ liệu đầu tiên của hãng, một bộ xử lý dựa trên ARM sẽ mang lại hiệu suất gấp 10 lần so với các máy chủ nhanh nhất hiện nay trên các workload xử lý AI hiệu năng cao và phức tạp nhất.

- Bộ xử lý Grace có bước nhảy vọt 10x hiệu năng dành cho các hệ thống đào tạo các mô hình AI khổng lồ, sử dụng lõi ARM tiết kiệm năng lượng

- Trung tâm Siêu máy tính Thụy Sĩ và Phòng thí nghiệm Quốc gia Los Alamos của Bộ Năng lượng Hoa Kỳ là hai nơi đầu tiên chế tạo Siêu máy tính chạy CPU NVIDIA

Ngay tại ngày khai mạc GTC 21, NVIDIA đã công bố CPU trung tâm dữ liệu đầu tiên của họ, một bộ xử lý dựa trên ARM sẽ mang lại hiệu suất gấp 10 lần so với các máy chủ nhanh nhất hiện nay trên các workload xử lý AI hiệu năng cao và phức tạp nhất.

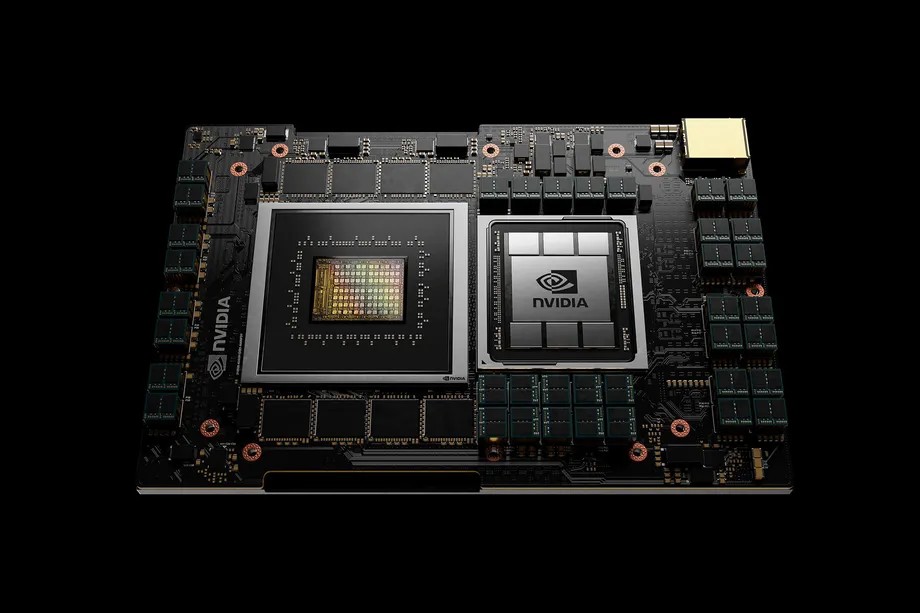

Là kết quả của hơn ‘10.000 năm làm việc’ trong quá trình nghiên cứu chế tạo, CPU NVIDIA Grace™ được thiết kế để đáp ứng các yêu cầu tính toán cho các ứng dụng tiên tiến nhất trên thế giới – bao gồm xử lý ngôn ngữ tự nhiên, hệ thống đề xuất và siêu máy tính AI – phân tích các bộ dữ liệu khổng lồ đòi hỏi cả hai yếu tố: xử lý cực nhanh và bộ nhớ cực lớn. Nó kết hợp các lõi CPU ARM tiết kiệm năng lượng với một hệ thống con các bộ nhớ tiêu tốn năng lượng thấp để mang lại hiệu năng cao nhất với hiệu quả tuyệt vời.

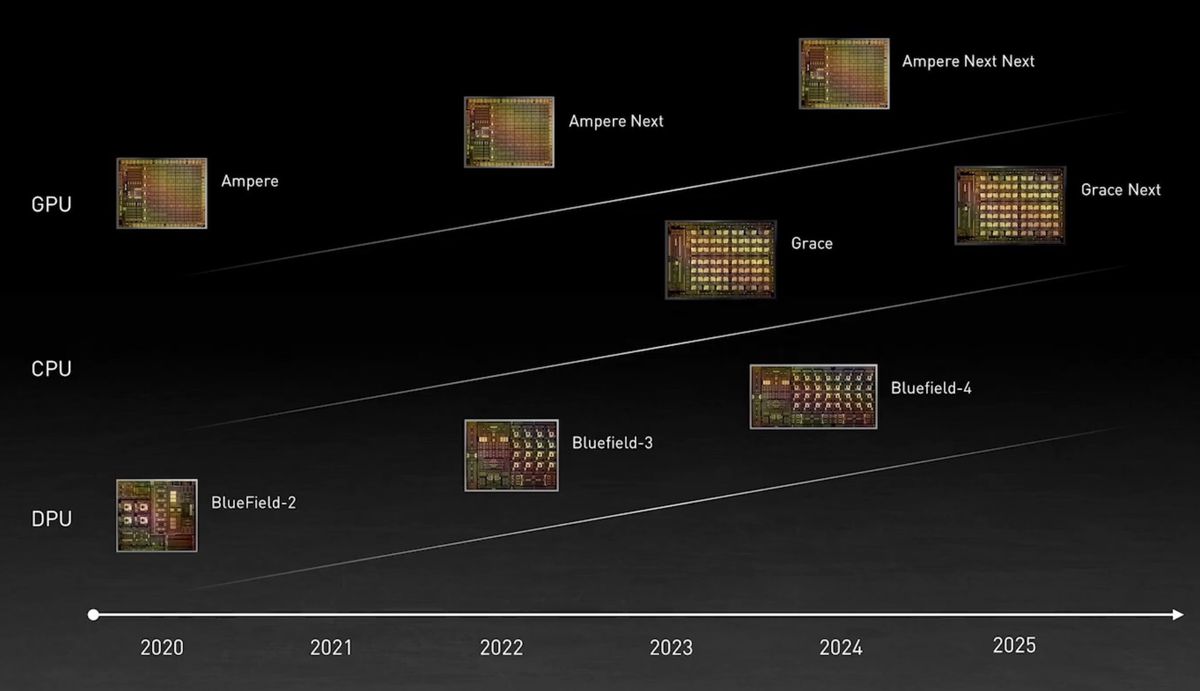

Jensen Huang, người sáng lập và Giám đốc điều hành của NVIDIA cho biết: “Khoa học dữ liệu và trí tuệ nhân tạo tiên tiến đang thúc đẩy kiến trúc máy tính ngày nay vượt quá giới hạn của nó – xử lý lượng dữ liệu không tưởng. Sử dụng ARM IP được cấp phép, NVIDIA đã thiết kế Grace như một CPU dành riêng cho AI và HPC quy mô lớn. Kết hợp với GPU và DPU, Grace cung cấp cho chúng ta công nghệ nền tảng thứ ba cho điện toán và khả năng tái kiến trúc trung tâm dữ liệu để nâng AI lên cấp độ mới. NVIDIA hiện là một ‘công ty ba chip’.”

Grace là một bộ xử lý chuyên biệt cao nhắm mục tiêu đến các workload chẳng hạn như đào tạo các mô hình NLP thế hệ mới có hơn 1 nghìn tỷ tham số. Khi được kết hợp chặt chẽ với GPU NVIDIA, hệ thống dựa trên CPU Grace sẽ mang lại hiệu suất nhanh hơn 10 lần so với hệ thống dựa trên NVIDIA DGX™ hiện đại nhất hiện nay, chạy trên CPU x86.

Trong khi phần lớn các trung tâm dữ liệu dự kiến sẽ được phục vụ bởi các CPU hiện có, Grace – được đặt theo tên của Grace Hopper, nhà tiên phong về lập trình máy tính của Hoa Kỳ – sẽ phục vụ một phân khúc máy tính thích hợp.

Trung tâm Siêu máy tính Quốc gia Thụy Sĩ (CSCS) và Phòng thí nghiệm Quốc gia Los Alamos của Bộ Năng lượng Hoa Kỳ là những cơ quan đầu tiên công bố kế hoạch chế tạo siêu máy tính chạy bằng Grace để hỗ trợ các nỗ lực nghiên cứu khoa học quốc gia.

NVIDIA tiến bước đến Grace vì khối lượng dữ liệu và kích thước của các mô hình AI đang tăng lên theo cấp số nhân. Các mô hình AI lớn nhất hiện nay có hàng tỷ tham số và đang tăng gấp đôi sau mỗi hai tháng rưỡi. Đào tạo chúng yêu cầu một CPU mới có thể kết hợp chặt chẽ với GPU để loại bỏ việc tắc nghẽn hệ thống.

NVIDIA đã xây dựng Grace bằng cách tận dụng sự linh hoạt của kiến trúc trung tâm dữ liệu được ARM thiết kế. Bằng cách giới thiệu một CPU cấp máy chủ mới, NVIDIA đang thúc đẩy mục tiêu đa dạng công nghệ trong cộng đồng AI và HPC, nơi lựa chọn là chìa khóa để mang lại sự đổi mới cần thiết nhằm giải quyết các vấn đề cấp bách nhất của thế giới.

“Là kiến trúc bộ xử lý được cấp phép rộng rãi nhất trên thế giới, ARM thúc đẩy sự đổi mới theo những cách mới lạ thường mỗi ngày”, CEO Simon Segars của ARM cho biết. “Việc NVIDIA giới thiệu CPU trung tâm dữ liệu Grace minh họa rõ ràng nhất về cách mô hình cấp phép của ARM tạo ra một phát minh quan trọng, một phát minh sẽ hỗ trợ đáng kể cho công việc của các nhà nghiên cứu và nhà khoa học AI ở khắp mọi nơi”.

Những nơi sử dụng đầu tiên của Grace “đẩy cao giới hạn của Khoa học và AI”

CSCS và Phòng thí nghiệm Quốc gia Los Alamos đều có kế hoạch đưa siêu máy tính chạy bằng Grace, do Hewlett Packard Enterprise xây dựng, lên mạng vào năm 2023.

“CPU Grace mới của NVIDIA cho phép chúng tôi hội tụ các công nghệ AI và siêu máy tính để giải quyết một số vấn đề khó nhất trong khoa học tính toán”, Giám đốc CSCS, GS Thomas Schulthess cho biết. “Chúng tôi rất vui mừng cung cấp CPU NVIDIA mới cho người dùng của chúng tôi ở Thụy Sĩ và trên toàn cầu để xử lý và phân tích các tập dữ liệu khoa học lớn và phức tạp”.

“Với sự cân bằng sáng tạo giữa băng thông bộ nhớ và dung lượng, hệ thống thế hệ tiếp theo này sẽ định hình chiến lược điện toán của tổ chức chúng tôi”, Thom Mason, Giám đốc Phòng thí nghiệm Quốc gia Los Alamos cho biết. “Nhờ CPU Grace mới của NVIDIA, chúng tôi sẽ có thể cung cấp các nghiên cứu khoa học tiên tiến bằng cách sử dụng mô phỏng và phân tích 3D có độ trung thực cao với bộ dữ liệu lớn hơn mức có thể trước đây”.

Mang đến hiệu suất đột phá

Bên dưới hiệu suất của Grace là công nghệ kết nối NVIDIA NVLink® thế hệ thứ tư, cung cấp kết nối kỷ lục 900 GB/s giữa Grace và GPU NVIDIA để cho phép băng thông tổng hợp cao hơn 30 lần so với các máy chủ hàng đầu hiện nay.

Grace cũng sẽ sử dụng một hệ thống con các bộ nhớ LPDDR5x mới, sẽ cung cấp băng thông gấp đôi và hiệu quả năng lượng tốt hơn 10 lần so với bộ nhớ DDR4. Ngoài ra, kiến trúc mới cung cấp sự kết hợp bộ nhớ đệm thống nhất với một không gian địa chỉ bộ nhớ duy nhất, kết hợp hệ thống và bộ nhớ GPU HBM để đơn giản hóa khả năng lập trình.

Grace sẽ được hỗ trợ bởi bộ công cụ phát triển phần mềm NVIDIA HPC và bộ thư viện CUDA® và CUDA-X™ đầy đủ, giúp tăng tốc hơn 2.000 ứng dụng GPU, tăng tốc độ khám phá cho các nhà khoa học và nhà nghiên cứu đang giải quyết những thách thức quan trọng nhất trên thế giới.

Dự kiến sẽ có thể đặt hàng vào đầu năm 2023.

Tìm hiểu thêm tại GTC21, diễn ra trực tuyến từ ngày 12 đến ngày 16 tháng 4 – đăng ký miễn phí.

Bài viết liên quan

- NVIDIA NGC‑ready Low‑latency Edge AI: Giải pháp cho Retail, Manufacturing và Smart Cities

- So sánh sức mạnh của máy tính AI DGX Spark với các card GPU máy trạm chuyên nghiệp của NVIDIA

- Từ Orin đến Thor: Bước nhảy vọt kiến trúc của NVIDIA JetPack 7.0 và tương lai của robot hình người

- Tại sao gọi NVIDIA DGX Spark là Siêu máy tính AI cá nhân?

- Cơ chế quản lý bộ nhớ trên các nền tảng phần cứng nhất quán – Hardware-coherent

- Kiến trúc NVIDIA Blackwell với GB200 NVL72: Định nghĩa lại điện toán AI cấp độ Exascale