Bài phát biểu chính của vị CEO NVIDIA từ COMPUTEX đã giới thiệu các hệ thống, phần mềm và dịch vụ mới – nhiều hệ thống được cung cấp bởi các siêu chip Grace Hopper – để khai thác Generative AI, công nghệ mang tính biến đổi nhất của thời đại chúng ta.

Trong bài phát biểu trực tiếp đầu tiên của mình kể từ sau đại dịch, Jensen Huang, người sáng lập kiêm Giám đốc điều hành NVIDIA hôm nay đã khai mạc hội nghị COMPUTEX tại Đài Bắc, công bố các nền tảng mà các công ty có thể sử dụng để thúc đẩy làn sóng trí tuệ nhân tạo mang tính lịch sử đang chuyển đổi các ngành từ quảng cáo sang sản xuất sang viễn thông.

“Chúng tôi đã trở lại”, Huang hô to khi bước lên sân khấu sau nhiều năm chỉ phát biểu khai mạc trên nền tảng ảo, một số lần là từ nhà bếp của ông ấy. “Tôi đã không có bài phát biểu trước công chúng trong gần bốn năm – chúc tôi may mắn!”

Phát biểu trong gần hai giờ trước một tòa nhà chật kín với khoảng 3.500 thính giả, ông đã mô tả các dịch vụ điện toán, phần mềm và hệ thống được tăng tốc đang hỗ trợ các mô hình kinh doanh mới và làm cho các mô hình kinh doanh hiện tại trở nên hiệu quả hơn.

“Máy tính tăng tốc và AI đánh dấu sự tái phát minh của máy tính”, Huang, vị CEO đã đi du lịch ở quê nhà trong tuần qua và đã được truyền thông địa phương theo dõi hàng ngày.

Để chứng minh sức mạnh của nó, ông đã sử dụng màn hình 8K khổng lồ trên sân khấu để hiển thị dòng text đang tạo ra bài hát chủ đề cho bài phát biểu chính của mình, có thể hát được như bất kỳ giai điệu karaoke nào. Huang, thỉnh thoảng nói đùa với đám đông bằng tiếng Đài Loan của quê hương ông, đã dẫn dắt khán giả hát bài quốc ca mới trong một thời gian ngắn.

“Chúng ta hiện đang ở đỉnh cao của kỷ nguyên điện toán mới với điện toán tăng tốc và AI được hầu hết mọi công ty điện toán và đám mây trên thế giới chấp nhận,” ông nói, đồng thời lưu ý rằng 40.000 công ty lớn và 15.000 công ty khởi nghiệp hiện đang sử dụng công nghệ NVIDIA với 25 triệu lượt tải xuống phần mềm CUDA chỉ riêng trong năm ngoái.

Một công cụ mới cho AI cấp doanh nghiệp

Đối với các doanh nghiệp cần hiệu suất AI cao nhất, ông đã tiết lộ về hệ thống DGX GH200, một siêu máy tính AI có bộ nhớ lớn. Nó sử dụng công nghệ NVIDIA NVLink để kết hợp lên đến 256 chiếc “siêu chip” NVIDIA GH200 Grace Hopper thành một GPU có quy mô trung tâm dữ liệu duy nhất.

Siêu chip GH200 mà Jensen cho biết hiện đã được cho sản xuất hoàn chỉnh, kết hợp CPU NVIDIA Grace tiết kiệm năng lượng với GPU NVIDIA H100 Tensor Core hiệu suất cao trong một superchip đặc biệt.

DGX GH200 có hiệu năng vượt trội và 144 terabyte bộ nhớ dùng chung, nhiều hơn gần 500 lần so với trong một hệ thống NVIDIA DGX A100 320GB. Điều đó cho phép các nhà phát triển xây dựng các mô hình ngôn ngữ lớn cho các chatbot sử dụng Generative AI, các thuật toán phức tạp cho các hệ thống recommender và graph neural network được sử dụng để phát hiện gian lận và phân tích dữ liệu.

Google Cloud, Meta và Microsoft là một trong số những công ty đầu tiên được cho là sẽ có quyền truy cập vào DGX GH200, đó có thể được xem là nền móng cho các hạ tầng Generative AI cấp hyperscale trong tương lai.

Siêu máy tính AI DGX GH200 của NVIDIA mang lại hiệu suất 1 exaflop cho Generative AI.

“Siêu máy tính DGX GH200 AI tích hợp các công nghệ mạng và điện toán tăng tốc tiên tiến nhất của NVIDIA để mở rộng ranh giới của AI”, Huang nói với khán giả ở Đài Bắc, nhiều người trong số họ đã xếp hàng bên ngoài hội trường hàng giờ trước khi mở cửa.

NVIDIA đang xây dựng siêu máy tính AI khổng lồ của riêng mình, NVIDIA Helios, sẽ ra mắt trong năm nay. Nó sẽ sử dụng bốn hệ thống DGX GH200 được liên kết với mạng NVIDIA Quantum-2 InfiniBand để tăng cường thông lượng dữ liệu nhằm đào tạo các mô hình AI lớn.

DGX GH200 là đỉnh cao của hàng trăm hệ thống được công bố tại sự kiện này. Cùng nhau, chúng đang mang Generative AI và điện toán tăng tốc đến cho hàng triệu người dùng trên khắp thế giới.

Thu lại bức tranh toàn cảnh, Huang đã công bố hơn 400 cấu hình hệ thống sắp được tung ra thị trường được hỗ trợ bởi các kiến trúc Hopper, Grace, Ada Lovelace và BlueField mới nhất của NVIDIA. Chúng nhằm mục đích giải quyết những thách thức phức tạp nhất trong AI, khoa học dữ liệu và điện toán hiệu năng cao.

Tăng tốc ở mọi quy mô

Để phù hợp với nhu cầu của các trung tâm dữ liệu ở mọi quy mô, Huang đã công bố nền tảng NVIDIA MGX, một kiến trúc tham chiếu mô-đun hóa để tạo ra các máy chủ tăng tốc. Các nhà sản xuất hệ thống sẽ sử dụng nó để xây dựng hơn một trăm cấu hình máy chủ khác nhau một cách nhanh chóng và tiết kiệm chi phí để phù hợp với nhiều loại ứng dụng AI, HPC và NVIDIA Omniverse .

MGX cho phép các nhà sản xuất xây dựng CPU và máy chủ tăng tốc sử dụng kiến trúc chung và các thành phần mô-đun. Nó hỗ trợ toàn bộ các dòng GPU, CPU, bộ xử lý dữ liệu (DPU) và bộ điều hợp mạng của NVIDIA cũng như bộ xử lý x86 và Arm trên nhiều kiểu chassis làm mát bằng không khí và bằng chất lỏng.

QCT và Supermicro sẽ là những công ty đầu tiên tung ra thị trường các thiết kế MGX xuất hiện vào tháng 8 tới. Hệ thống ARS-221GL-NR của Supermicro được công bố tại COMPUTEX sẽ sử dụng CPU Grace, trong khi hệ thống S74G-2U của QCT, cũng được công bố tại sự kiện, sử dụng Grace Hopper.

ASRock Rack, ASUS, GIGABYTE và Pegatron cũng sẽ sử dụng MGX để tạo ra các máy tính tăng tốc thế hệ tiếp theo.

Ngành viễn thông với công nghệ 5G/6G đang gọi tên Grace Hopper

Một cách riêng biệt, Huang cho biết NVIDIA đang giúp định hình lĩnh vực truyền thông không dây 5G/6G và video trong tương lai. Một bài demo cho thấy AI chạy trên Grace Hopper sẽ biến các cuộc gọi video 2D ngày nay thành trải nghiệm 3D chân thực hơn như thế nào, mang lại “cảm giác của sự hiện diện” đáng kinh ngạc.

Đặt nền móng cho các loại dịch vụ mới, Huang thông báo NVIDIA đang hợp tác với gã khổng lồ viễn thông SoftBank để xây dựng một mạng lưới trung tâm dữ liệu phân tán tại Nhật Bản. Nó sẽ cung cấp các dịch vụ 5G và các ứng dụng Generative AI trên một nền tảng đám mây chung.

Các trung tâm dữ liệu sẽ sử dụng siêu chip NVIDIA GH200 và DPU NVIDIA BlueField-3 trong các hệ thống MGX mô-đun hóa, cũng như các bộ chuyển mạch NVIDIA Spectrum Ethernet để cung cấp thời gian chính xác cao mà giao thức 5G yêu cầu. Nền tảng này sẽ cắt giảm chi phí bằng cách tăng hiệu suất chung, đồng thời giảm mức tiêu thụ năng lượng.

Các hệ thống này sẽ giúp SoftBank khám phá các ứng dụng 5G trong lĩnh vực lái xe tự động, nhà máy AI, thực tế ảo/tăng cường (VR/AR), thị giác máy tính và digital twin. Các mục đích sử dụng trong tương lai thậm chí có thể bao gồm hội nghị truyền hình 3D và truyền thông ba chiều.

Tăng tốc hệ thống mạng đám mây

Một cách riêng biệt, Huang đã tiết lộ NVIDIA Spectrum-X, một nền tảng mạng được xây dựng nhằm mục đích cải thiện hiệu suất và hiệu quả của các đám mây AI dựa trên Ethernet. Nó kết hợp các bộ chuyển mạch Ethernet Spectrum-4 với DPU BlueField-3 và phần mềm để mang lại mức tăng 1.7 lần về hiệu suất AI và hiệu suất năng lượng so với các mạng Ethernet truyền thống.

NVIDIA Spectrum-X, bộ chuyển mạch Spectrum-4 và DPU BlueField-3 hiện đã có sẵn từ các nhà sản xuất hệ thống bao gồm Dell Technologies, Lenovo và Supermicro.

NVIDIA Spectrum-X tăng tốc quy trình công việc AI có thể bị giảm hiệu suất trên các mạng Ethernet truyền thống.

Đưa các nhân vật trong game vào đời thực

Generative AI cũng mang những tác động đến cách mọi người giải trí.

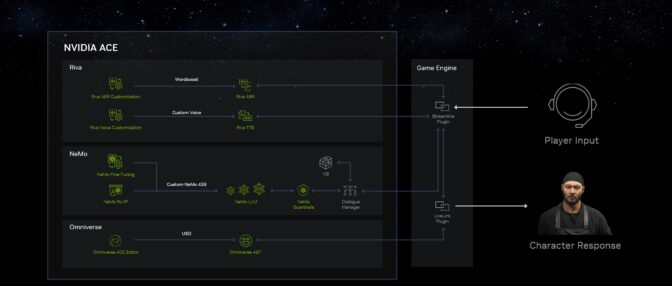

Huang đã công bố NVIDIA Avatar Cloud Engine (ACE) cho lĩnh vực gaming, một dịch vụ nền tảng mà các nhà phát triển có thể sử dụng để xây dựng và triển khai các mô hình AI tùy chỉnh cho lời nói, hội thoại và hoạt ảnh. Nó sẽ cung cấp cho các nhân vật không thể chơi được các kỹ năng đàm thoại để họ có thể trả lời các câu hỏi với tính cách sống động như thật đang phát triển.

NVIDIA ACE for Games bao gồm các mô hình nền tảng AI như NVIDIA Riva để phát hiện và phiên âm lời nói của người chơi. Văn bản nhắc NVIDIA NeMo tạo hoạt ảnh phản hồi tùy chỉnh với NVIDIA Omniverse Audio2Face .

NVIDIA ACE for Games cung cấp một chuỗi công cụ để đưa các nhân vật vào cuộc sống với Generative AI.

Tăng tốc Generative AI trên Windows

Huang đã mô tả cách NVIDIA và Microsoft đang hợp tác để thúc đẩy sự đổi mới cho PC chạy Windows trong kỷ nguyên của Generative AI.

Các công cụ, frameworks và trình điều khiển mới và nâng cao đang giúp các nhà phát triển PC phát triển và triển khai AI dễ dàng hơn. Ví dụ: chuỗi công cụ Microsoft Olive để tối ưu hóa và triển khai các mô hình AI được tăng tốc bởi GPU và trình điều khiển đồ họa mới sẽ tăng hiệu suất DirectML trên PC Windows có GPU NVIDIA.

Sự hợp tác này sẽ nâng cao và mở rộng cơ sở đã cài đặt gồm 100 triệu PC có GPU RTX với Lõi Tensor giúp tăng hiệu suất của hơn 400 ứng dụng và trò chơi Windows được tăng tốc bởi AI.

Số hóa các ngành công nghiệp lớn nhất thế giới

Generative AI (AI tạo sinh, AI tổng hợp) cũng đang tạo ra những cơ hội mới trong ngành quảng cáo kỹ thuật số trị giá 700 tỷ USD.

Ví dụ: WPP, công ty cung cấp dịch vụ tiếp thị lớn nhất thế giới, đang hợp tác với NVIDIA để xây dựng một công cụ nội dung hỗ trợ bởi Generative AI đầu tiên thuộc loại này trên Omniverse Cloud.

Trong một bài demo, Huang đã chỉ ra cách các nhóm sáng tạo sẽ kết nối các công cụ thiết kế 3D của họ như Adobe Substance 3D, để xây dựng phiên bản số cho các sản phẩm của khách hàng trong NVIDIA Omniverse. Sau đó, nội dung từ các công cụ Generative AI được đào tạo dựa trên dữ liệu có nguồn gốc hợp lý và được xây dựng bằng NVIDIA Picasso sẽ cho phép họ nhanh chóng tạo ra các bộ ảo. Sau đó, khách hàng WPP có thể sử dụng cảnh hoàn chỉnh để tạo một loạt quảng cáo, video và trải nghiệm 3D cho thị trường toàn cầu và người dùng trải nghiệm trên bất kỳ thiết bị web nào.

“Ngày nay, quảng cáo là chiều truy xuất, nhưng trong tương lai khi bạn tương tác, phần lớn thông tin đó là sẽ được tạo ra — mô hình điện toán đã thay đổi”, Huang nói.

Các nhà máy tạo nên một tương lai AI

Với ước tính khoảng 10 triệu nhà máy, lĩnh vực sản xuất trị giá 46 nghìn tỷ đô la là một lĩnh vực phong phú để số hóa công nghiệp.

“Các ngành công nghiệp lớn nhất thế giới tạo ra những thứ vật chất. Xây dựng chúng bằng kỹ thuật số trước tiên có thể tiết kiệm hàng tỷ đô la,” Huang nói.

Bài keynote cho thấy cách các nhà sản xuất thiết bị điện tử bao gồm Foxconn Industrial Internet, Innodisk, Pegatron, Quanta và Wistron đang tạo ra quy trình công việc kỹ thuật số bằng công nghệ NVIDIA để hiện thực hóa tầm nhìn về một nhà máy thông minh được số hóa hoàn toàn.

Họ đang sử dụng Omniverse và API của Generative AI để kết nối các công cụ thiết kế và sản xuất của họ, để họ có thể xây dựng các nhà máy digital twin. Ngoài ra, họ sử dụng NVIDIA Isaac Sim để mô phỏng và thử nghiệm rô-bốt và NVIDIA Metropolis, một framework về Vision AI, để kiểm soát hình ảnh tự động.

Thành phần mới nhất, NVIDIA Metropolis for Factory, có thể tạo ra các hệ thống kiểm soát chất lượng tùy chỉnh, mang lại lợi thế cạnh tranh cho các nhà sản xuất. Nó đang giúp các công ty phát triển các ứng dụng AI tiên tiến nhất.

Tăng tốc các dây chuyền lắp ráp

Ví dụ: Pegatron – công ty sản xuất 300 sản phẩm trên toàn thế giới, bao gồm cả máy tính xách tay và điện thoại thông minh – đang tạo ra các nhà máy ảo với Omniverse, Isaac Sim và Metropolis. Điều đó cho phép họ thử các quy trình trong môi trường mô phỏng, tiết kiệm thời gian và chi phí.

Pegatron cũng sử dụng bộ công cụ phát triển phần mềm NVIDIA DeepStream để phát triển các ứng dụng video thông minh giúp cải thiện thông lượng gấp 10 lần.

Foxconn Industrial Internet, một nhánh dịch vụ của nhà sản xuất công nghệ lớn nhất thế giới, đang làm việc với các đối tác của NVIDIA Metropolis để tự động hóa các phần quan trọng trong các checkpoints đảm bảo chất lượng bảng mạch của mình.

Đám đông xếp hàng cho bài phát biểu quan trọng hàng giờ trước khi cửa mở.

Trong một video, Huang cho thấy Techman Robot, một công ty con của Quanta, đã khai thác NVIDIA Isaac Sim như thế nào để tối ưu hóa quá trình kiểm tra trên các dây chuyền sản xuất của gã khổng lồ có trụ sở tại Đài Loan. Về cơ bản, nó sử dụng rô-bốt mô phỏng để huấn luyện rô-bốt cách tạo ra rô-bốt tốt hơn.

Ngoài ra, Huang đã công bố một nền tảng mới để kích hoạt các đội robot di động tự động (AMR) thế hệ tiếp theo. Isaac AMR giúp mô phỏng, triển khai và quản lý đội robot di động tự động.

Huang cho biết một hệ sinh thái đối tác lớn — bao gồm ADLINK, Aetina, Deloitte, Quantiphi và Siemens — đang giúp đưa tất cả các giải pháp cấp độ sản xuất này ra thị trường.

Đây là một ví dụ nữa về cách NVIDIA đang giúp các công ty cảm nhận được lợi ích của Generative AI với điện toán tăng tốc.

“Đã lâu rồi tôi không gặp các bạn, vì vậy tôi có rất nhiều điều muốn nói”, ông nói sau cuộc nói chuyện kéo dài hai giờ trong tiếng vỗ tay nồng nhiệt.

Bài viết liên quan

- NVIDIA RTX PRO 4500 Blackwell Server Edition: Bước nhảy vọt từ thế hệ L4 cho hạ tầng AI suy luận hiệu năng cao

- NVIDIA NGC‑ready Low‑latency Edge AI: Giải pháp cho Retail, Manufacturing và Smart Cities

- So sánh sức mạnh của máy tính AI DGX Spark với các card GPU máy trạm chuyên nghiệp của NVIDIA

- Từ Orin đến Thor: Bước nhảy vọt kiến trúc của NVIDIA JetPack 7.0 và tương lai của robot hình người

- Tại sao gọi NVIDIA DGX Spark là Siêu máy tính AI cá nhân?

- Cơ chế quản lý bộ nhớ trên các nền tảng phần cứng nhất quán – Hardware-coherent