Mô hình ngôn ngữ lớn (LLM) là các thuật toán Học sâu (deep learning) được đào tạo trên những bộ dữ liệu quy mô Internet với hàng trăm tỷ tham số. Các LLM có thể đọc, viết, code, vẽ và tăng cường khả năng sáng tạo của con người để cải thiện năng suất trong các…

Tag: H100

GPU NVIDIA H100 có thể làm được những gì?

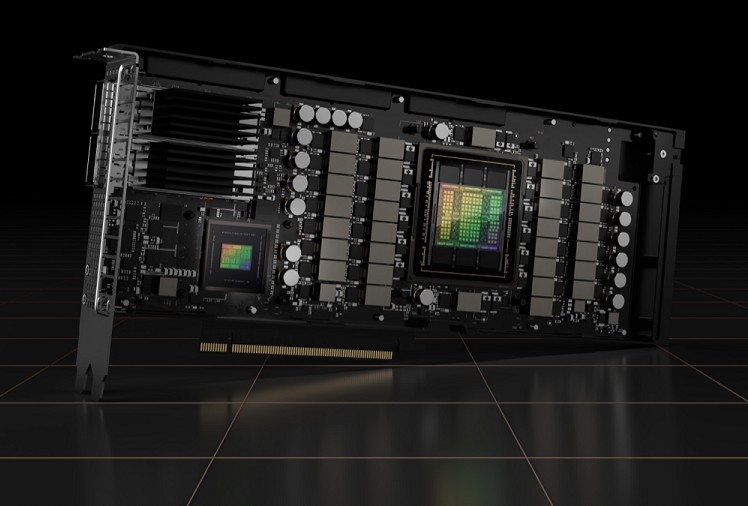

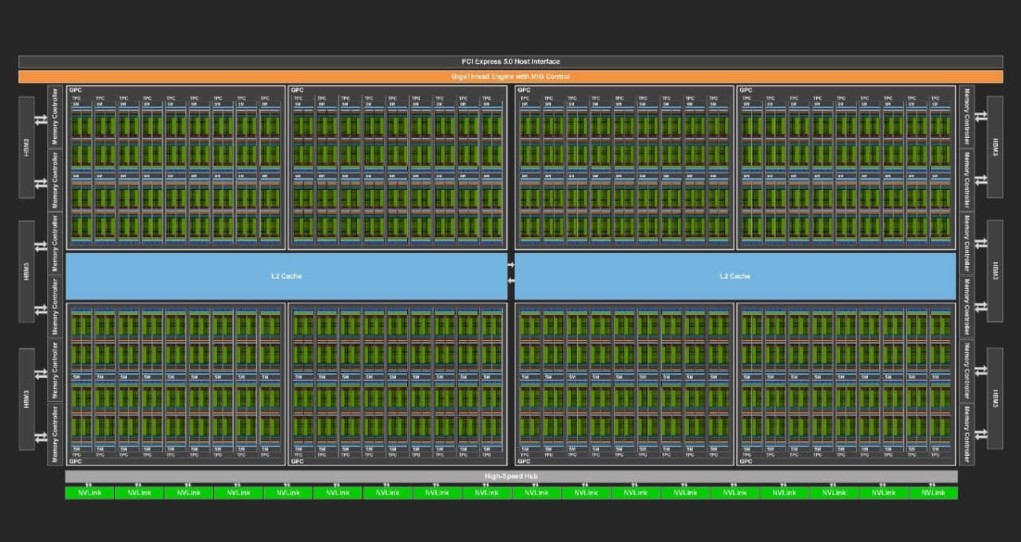

H100 được xây dựng trên kiến trúc GPU NVIDIA Hopper tiên tiến nhất hiện nay, đây là lựa chọn lý tưởng cho các ứng dụng yêu cầu sức mạnh tính toán nhanh chớp nhoáng. Với Tensor Cores thế hệ thứ tư, H100 mang đến khả năng đào tạo AI nhanh hơn đến 5 lần và tốc độ…

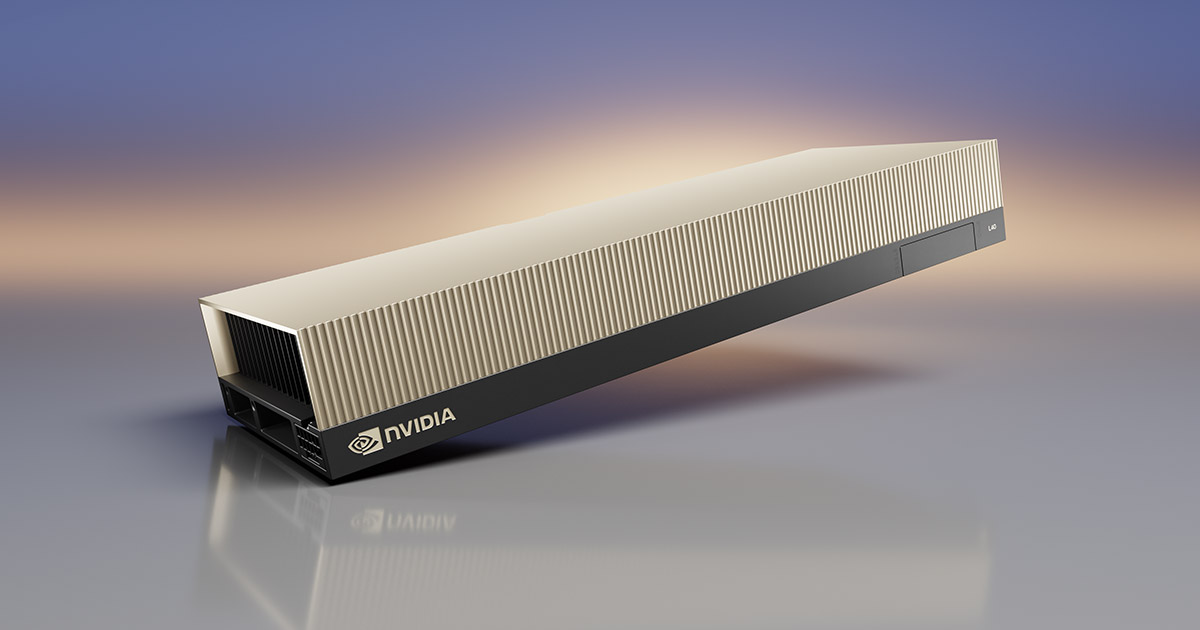

GPU NVIDIA L40S: Sự đổi mới và tính hiệu quả cho Trí Tuệ Nhân Tạo

Với những chuyển biến của thị trường gần đây, NVIDIA H100 80GB PCIe đang được bán với mức giá trên 30 nghìn USD tại các cửa hàng trực tuyến và đang trong tình trạng chờ đợi khoảng sáu tháng để nhận hàng. Dễ hiểu khi giá của dòng GPU đầu bảng này của NVIDIA cao…

Các nhà thiết kế khai thác Generative AI để hỗ trợ thiết kế chip

Các kỹ sư bán dẫn cho thấy cách một ngành chuyên biệt có thể tùy chỉnh các mô hình ngôn ngữ lớn (LLMs) để đạt được lợi thế khi sử dụng NVIDIA NeMo. Một bài nghiên cứu được phát hành hôm nay mô tả những cách mà Generative AI (GenAI) có thể hỗ trợ một trong những nỗ lực…

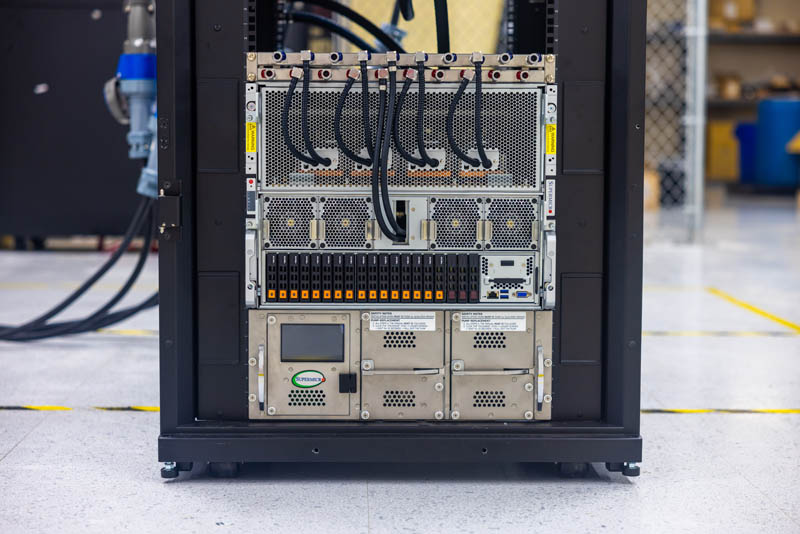

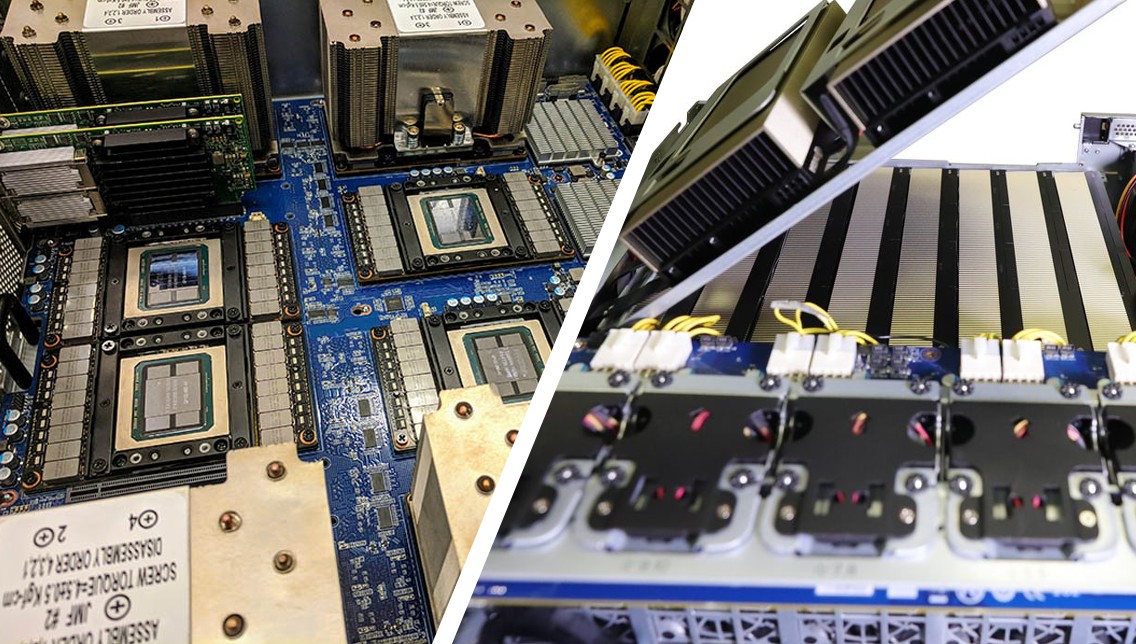

Cận cảnh máy chủ AI Supermicro SYS-821GE-TNHR 8x NVIDIA H100 làm mát bằng chất lỏng

Bài này sẽ cung cấp cho các bạn những góc nhìn cận cảnh của hệ thống máy chủ giải nhiệt nước đặc biệt Supermicro SYS-821GE-TNHR. Đây là hệ thống trang bị 8x GPU NVIDIA H100 với một điểm mới: nó được làm mát bằng chất lỏng để giảm chi phí làm mát và tiêu thụ điện…

“Siêu chip” NVIDIA Grace Hopper thống lĩnh các bài test benchmark MLPerf về suy luận

Siêu chip NVIDIA GH200, GPU H100, L4 và các module Jetson Orin cho thấy hiệu suất vượt trội khi chạy AI ở môi trường sản xuất, từ đám mây đến rìa mạng. Trong lần kiểm tra đầu tiên trên điểm benchmark chuyên ngành MLPerf, NVIDIA GH200 Grace Hopper Superchip đã chạy tất cả các bài test suy…

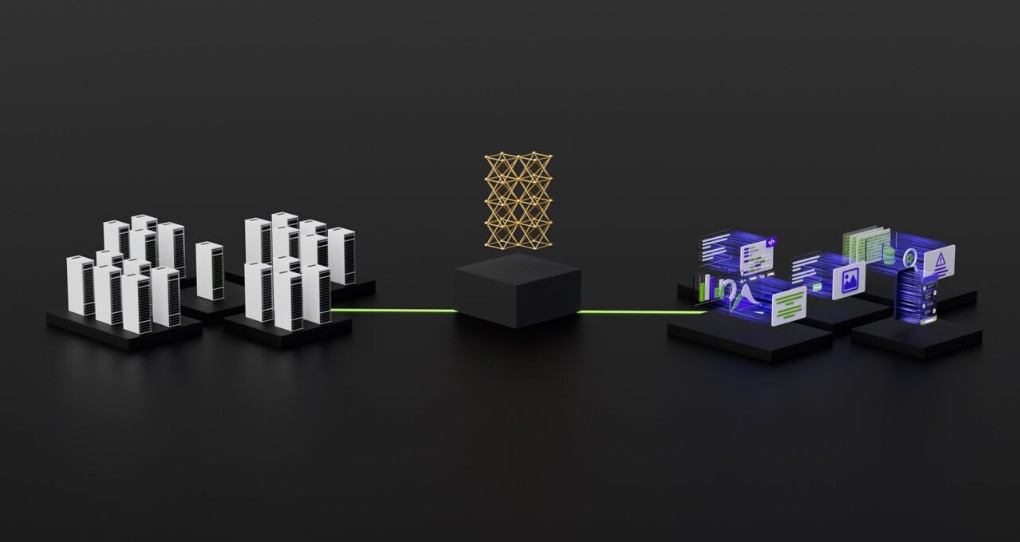

Google Cloud và NVIDIA mở rộng quan hệ đối tác để nâng cao dịch vụ, phần mềm, điện toán AI

Công nghệ Generative AI của NVIDIA được Google DeepMind và các nhóm nghiên cứu của Google sử dụng hiện đã được tối ưu hóa và có sẵn cho khách hàng của Google Cloud trên toàn thế giới Tại hội nghị Google Cloud Next – Google Cloud và NVIDIA đã công bố cơ sở hạ tầng…

SXM vs PCIe: GPU nào tốt nhất cho đào tạo các mô hình ngôn ngữ lớn (LLM) như GPT-4?

NLP là gì và LLM là gì? Xử lý ngôn ngữ tự nhiên (NLP) là một nhánh của Trí tuệ nhân tạo (AI) cho phép máy móc hiểu và diễn giải ngôn ngữ của con người. Những tiến bộ gần đây trong học sâu đã dẫn đến sự xuất hiện của các mô hình ngôn ngữ…

NVIDIA H100 đặt tiêu chuẩn cho Generative AI với điểm benchmark MLPerf

Người dùng chuyên sâu và các chuẩn benchmark đầu ngành đều cho thấy: Các GPU NVIDIA H100 Tensor Core mang lại hiệu suất AI tốt nhất, đặc biệt là trên các mô hình ngôn ngữ lớn (LLM) – thứ cung cấp sức mạnh cho AI tạo sinh (Generative AI). GPU NVIDIA H100 đã thiết lập những…

H100 – GPU đầu bảng của NVIDIA có thể làm được gì?

GPU H100, được xây dựng trên kiến trúc NVIDIA Hopper tiên tiến, là lựa chọn lý tưởng cho các ứng dụng chuyên sâu yêu cầu tốc độ xử lý cao. Với Tensor Core thế hệ thứ tư, H100 cung cấp khả năng đào tạo AI nhanh hơn đến 5 lần và tốc độ suy luận AI nhanh…