Doanh nghiệp của bạn có đang tìm kiếm, khao khát một giải pháp đột phá để khai phá tiềm năng của trí tuệ nhân tạo AI? Hay có đang cảm thấy mình bị bỏ lại phía sau trong cuộc đua AI đầy khốc liệt? Hãy cùng chúng tôi khám phá NVIDIA DGX B300, “nhà máy AI” thế…

AI – HPC

VAST Data tăng cường vị thế dẫn đầu về lưu trữ AI với chứng nhận NVIDIA-Certified Storage

Khi AI định hình lại các ngành công nghiệp và các doanh nghiệp đẩy nhanh quá trình đổi mới do AI thúc đẩy, nhu cầu về các giải pháp lưu trữ hiệu suất cao, có khả năng mở rộng và đáng tin cậy chưa bao giờ lớn hơn thế. VAST vừa thông báo rằng họ…

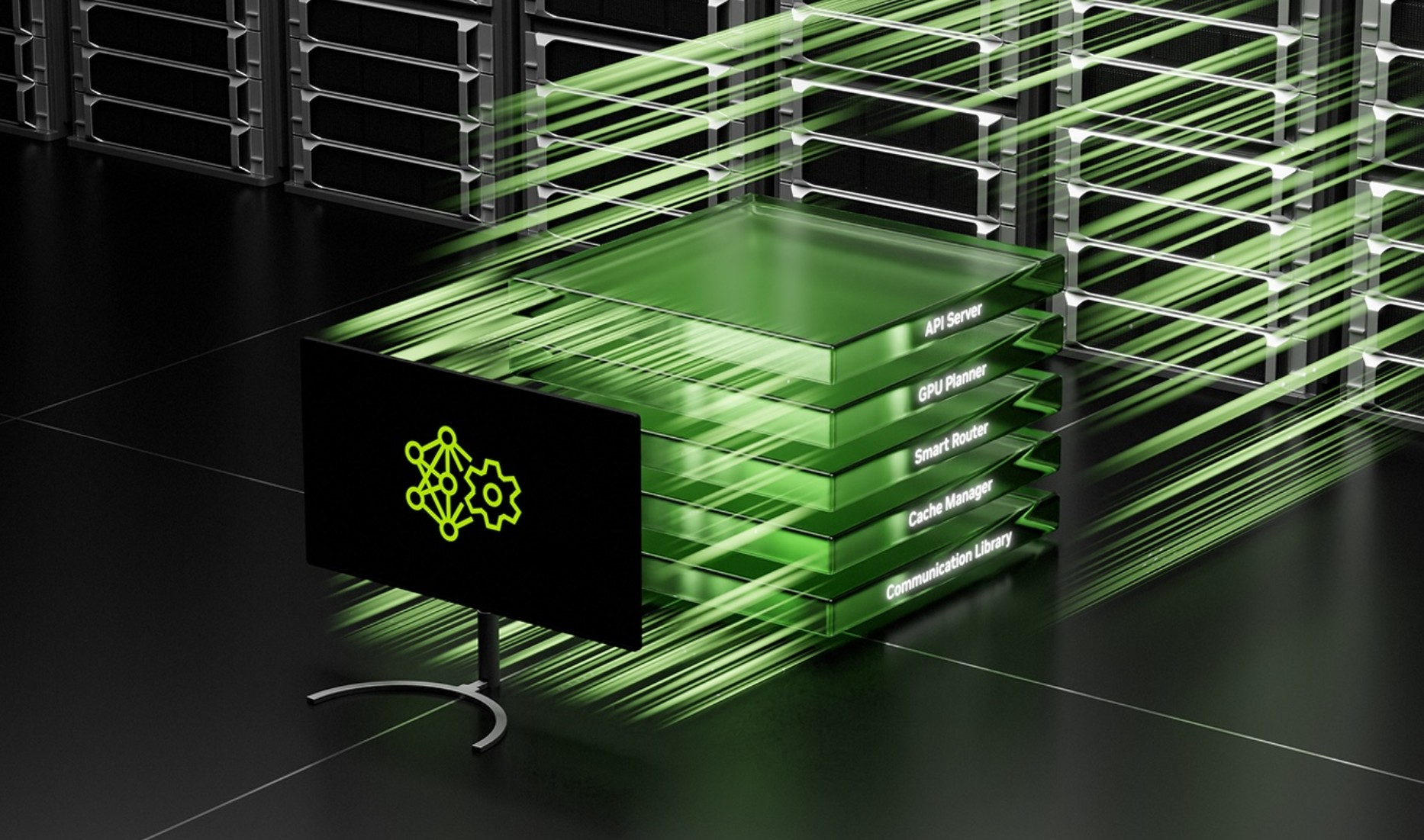

NVIDIA Dynamo – Thư viện nguồn mở tăng tốc và mở rộng các mô hình lý luận AI

NVIDIA Dynamo tăng cường hiệu suất suy luận trong khi giảm chi phí cho việc mở rộng quy mô tính toán giai đoạn thử nghiệm; Khả năng suy luận tối ưu trên NVIDIA Blackwell giúp tăng thông lượng lên 30 lần trên DeepSeek-R1. NVIDIA vừa ra mắt NVIDIA Dynamo, một phần mềm suy luận nguồn mở giúp…

NVIDIA Spectrum-X Photonics, bộ chuyển mạch quang tử giúp mở rộng AI Factory lên hàng triệu GPU

NVIDIA vừa công bố các bộ chuyển mạch quang tử (photonics) NVIDIA Spectrum-X và NVIDIA Quantum-X, cho phép các nhà máy AI kết nối hàng triệu GPU trên khắp các địa điểm trong khi giúp làm giảm đáng kể mức tiêu thụ năng lượng và chi phí vận hành. NVIDIA đã đạt được sự hợp…

AI Factory thế hệ mới với hệ thống DGX SuperPOD dựa trên Blackwell Ultra

GTC25 – NVIDIA chính thức ra mắt nền tảng hạ tầng AI tiên tiến nhất dành cho doanh nghiệp – NVIDIA DGX SuperPOD, được trang bị GPU Blackwell Ultra. Đây là giải pháp siêu máy tính AI hoàn chỉnh, giúp các doanh nghiệp xây dựng “nhà máy AI” (AI factory) với khả năng xử lý…

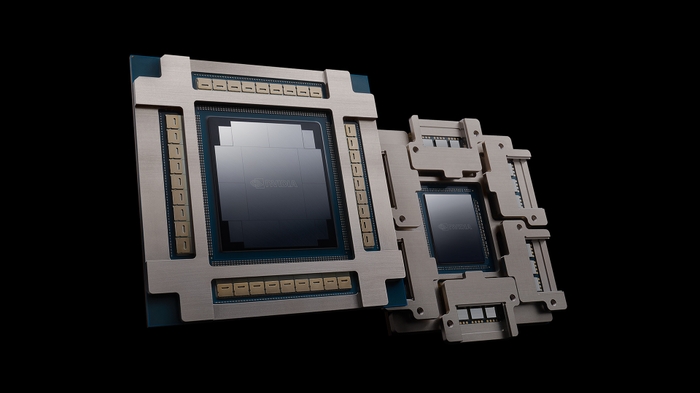

NVIDIA Blackwell Ultra: Mở ra kỷ nguyên Trí Tuệ Nhân Tạo lý luận

Tại hội nghị GTC25, NVIDIA chính thức ra mắt NVIDIA Blackwell Ultra – thế hệ tiếp theo của nền tảng AI Blackwell, mở đường cho kỷ nguyên lập luận AI (AI Reasoning). Đây là bước tiến lớn trong việc tăng cường hiệu suất huấn luyện và suy luận AI, giúp các tổ chức trên toàn…

NVIDIA và các nhà cung cấp lưu trữ hàng đầu tiết lộ hạ tầng doanh nghiệp mới cho thời đại AI

Các nhà cung cấp lưu trữ xây dựng hạ tầng có các agent truy vấn bằng AI để khai thác nền tảng điện toán, mạng và phần mềm của NVIDIA cho việc suy luận và nhanh chóng tạo ra phản hồi chính xác cho các truy vấn phức tạp.

Chương trình chứng nhận của NVIDIA mở rộng sang hệ thống lưu trữ

Chứng nhận lưu trữ mới và kiến trúc tham chiếu giúp IT doanh nghiệp dễ dàng lựa chọn và triển khai hạ tầng AI để có hiệu suất và hiệu quả tối ưu. Việc triển khai AI phát triển mạnh mẽ nhờ tốc độ, dữ liệu và quy mô. Đó là lý do tại sao…

NVIDIA công bố máy tính AI cá nhân DGX Spark và DGX Station

Được hỗ trợ bởi nền tảng xử lý NVIDIA Grace Blackwell, Siêu máy tính để bàn đưa AI tăng tốc vào tay các nhà phát triển, nhà nghiên cứu và nhà khoa học dữ liệu; Hệ thống đến từ các nhà sản xuất máy tính hàng đầu bao gồm ASUS, Dell Technologies, HP và Lenovo….

AI Factory đang định nghĩa lại các trung tâm dữ liệu cho kỷ nguyên AI

AI đang nhen nhóm cho một cuộc cách mạng công nghiệp mới – một cuộc cách mạng được thúc đẩy bởi các Nhà máy AI (AI Factory). Không giống như các trung tâm dữ liệu truyền thống, các nhà máy AI không chỉ lưu trữ và xử lý dữ liệu — chúng sản xuất trí thông…