Trong khoảng hơn thập kỷ qua, các doanh nghiệp đã dần di chuyển các tải công việc ra khỏi các máy chủ tại chỗ để chuyển lên đám mây, nhằm tận dụng tính linh hoạt và tiết kiệm chi phí khi sử dụng hình thức thuê dịch vụ.

Do đó, thị trường điện toán đám mây toàn cầu được thiết lập có giá trị lên tới 250 tỷ USD trong năm nay, một phần lớn trong số đó sẽ rơi vào túi của những ông lớn toàn cầu như Amazon Web Services, Microsoft Azure và Google Cloud.

Tuy nhiên, nhiều dấu hiệu khác nhau cho thấy một làn sóng về điện toán đám mây đang bắt đầu chuyển sang một hướng khác, với tỷ lệ nhu cầu xử lý điện toán lớn lại diễn ra bên ngoài các trung tâm dữ liệu tập trung.

Mega-trend

Theo Mike Vildibill, giám đốc điều hành của Cloud Edge AI tại tập đoàn Qualcomm, sự trỗi dậy của trí tuệ nhân tạo (AI) sẽ kết hợp với một số yếu tố khác để đẩy điện toán ra rìa mạng, nơi mà độ trễ cũng quan trọng không kém so với vấn đề hiệu suất thuần túy.

“Xu hướng lớn tiếp theo hiện đang diễn ra”, ông nói với TechRadar. “Trước đây, chúng tôi thấy rất nhiều tải công việc chuyển sang đám mây, nhưng hiệu ứng yo-yo đang tạo ra nhu cầu xử lý gần rìa mạng hơn, nơi cả dữ liệu và người dùng dữ liệu cùng hiện diện”.

“Vẫn cần một đám mây tập trung, nhưng ngay cả những nhà cung cấp siêu quy mô, các hyperscaler, cũng nhận ra rằng đám mây đang tiến ra rìa mạng. Thay vì nằm trong một trung tâm dữ liệu xa xôi nào đó, nó có thể nằm trong thùng xe của bạn, ở ngã tư hoặc được gắn vào bên cạnh của một tòa nhà. Đó là tương lai.”.

Một hướng đi mới

NVIDIA vừa qua đã cho ra mắt module xử lý biên trong công nghiệp NVIDIA Jetson AGX Xavier, một nền tảng được thiết kế đặc biệt cho các tác vụ xử lý AI ngay tại biên, với khả năng chống chọi thời tiết và môi trường khắc nghiệt.

Module công nghiệp Jetson AGX Xavier

Module công nghiệp Jetson AGX Xavier

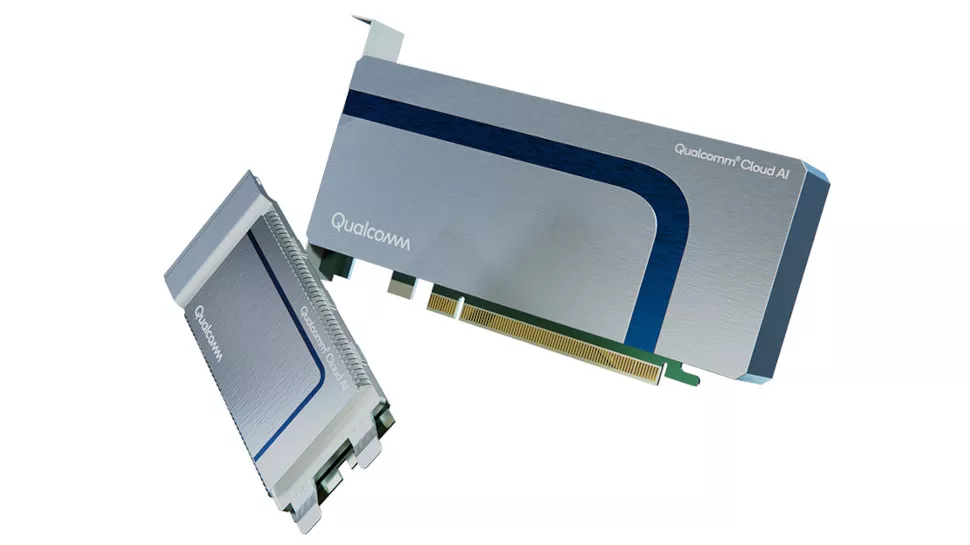

Còn với Qualcomm gần đây họ đã tung ra một mảng kinh doanh mới đang nhanh chóng thu hút sự chú ý của giới công nghệ. Trọng tâm là xây dựng chip máy chủ hiệu suất cao được thiết kế đặc biệt để tăng tốc suy luận của AI, cả trong đám mây và ở rìa. Được sản xuất trên quy trình 7nm, máy gia tốc Cloud AI 100 mới nhất của công ty dẫn đầu thị trường về cả mật độ hiệu suất và hiệu quả năng lượng, theo tiêu chuẩn MLPerf.

Ví dụ: Bộ công cụ phát triển cạnh Cloud AI 100 của Qualcomm (AEDK) được phát hiện để đạt được 240 suy luận mỗi giây trên mỗi watt (inf / giây / watt) cho ResNet-50, một mạng thần kinh thường được sử dụng để đánh giá hiệu suất suy luận. Để so sánh, AGX Xavier của Nvidia quản lý 60 inf / giây / watt, ít hơn bốn lần.

Qualcomm Cloud AI 100

Qualcomm Cloud AI 100

Một trường hợp ứng dụng nổi bật cho điện toán biên là xe tự lái, theo đó một chiếc xe thực hiện suy luận trên dữ liệu được lấy từ các camera và cảm biến khác nhau để vẽ lộ trình mà không cần người lái xe can thiệp.

Nếu có chướng ngại vật đột nhiên xuất hiện trên đường (ví dụ, một đứa trẻ bước ra từ phía sau một chiếc ô tô đang đỗ), việc điều chỉnh hướng đi cần được tính toán gần như ngay lập tức, theo cách mà chỉ có xử lý ngay tại biên mới có thể thực hiện được.

Vildibill cho biết: “Các quy luật vật lý quy định rằng dữ liệu không thể di chuyển đủ nhanh giữa xe hơi và trung tâm dữ liệu đám mây và quay trở lại trong khoảng thời gian đủ để thảm họa được ngăn chặn”. “Bạn cần thực hiện quá trình xử lý gần hơn với nơi lưu trữ dữ liệu.”

Và đây chỉ là một trong nhiều ví dụ, các nhà phát triển giải pháp đang tìm thấy nhiều trường hợp sử dụng mới khác nhau triển khai suy luận AI, từ việc theo dõi lượng hàng trên kệ trong môi trường cửa hàng bán lẻ đến việc kiểm tra công nhân nhà máy có mặc đồ bảo hộ cần thiết hay không. Cùng với 5G , điện toán biên cũng cho phép một loạt các ứng dụng thực tế ảo và thực tế tăng cường (AR / VR) mới trở nên khả thi.

Theo TechRadar

Bài viết liên quan

- Infortrend Enterprise Cloud – Giải pháp điện toán tập trung cho phát triển AI

- Điện toán đám mây: Những xu hướng mới sẽ rõ nét hơn trong năm 2025

- 10 cách để tối ưu hóa đám mây của bạn

- SOM – System On Module là gì?

- Tăng cường hiệu suất AI tại biên với Lanner Edge AI Appliance và NVIDIA Jetson

- Edge Computing – Điện toán biên là gì?