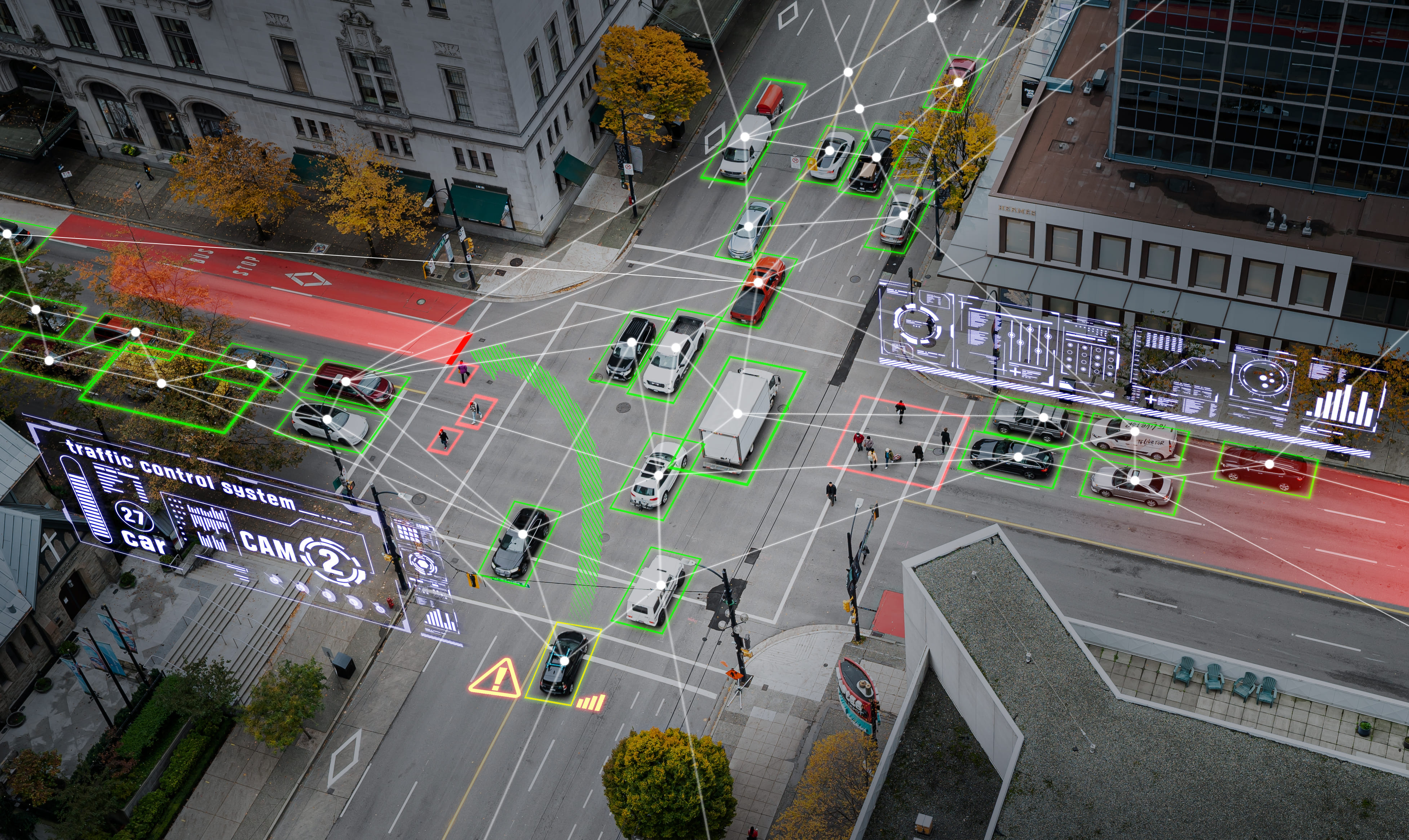

Trong bối cảnh đô thị hiện đại, việc quản lý giao thông không chỉ là quan sát mà đòi hỏi khả năng phản ứng tức thì. Giải pháp GoodVision Real-time Traffic Video Analytics, được xây dựng trên nền tảng IoT và AI, cho phép thu thập và phân tích dữ liệu để cải thiện việc…

AI – HPC

NVIDIA NGC‑ready Low‑latency Edge AI: Giải pháp cho Retail, Manufacturing và Smart Cities

Sự bùng nổ của các ứng dụng AI trong những thị trường cạnh tranh khiến yêu cầu phần cứng phải kéo được sức nặng của mô hình xuống tận “mép mạng” (Edge) – nơi dữ liệu được sinh ra từ camera, cảm biến, máy móc sản xuất hay hệ thống giao thông đô thị. Một…

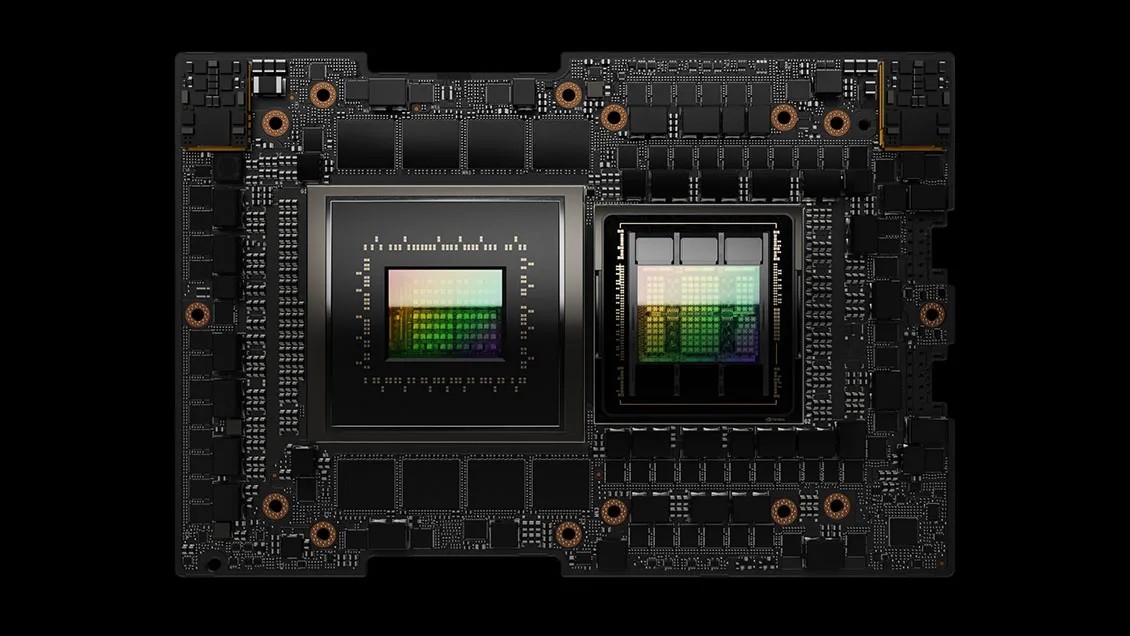

So sánh sức mạnh của máy tính AI DGX Spark với các card GPU máy trạm chuyên nghiệp của NVIDIA

Để tạo ra sức mạnh tương đương với NVIDIA DGX Spark bằng các card đồ họa rời (PCIe), bạn sẽ phải đối mặt với sự đánh đổi giữa Dung lượng bộ nhớ (Memory Capacity – mô hình lớn cỡ nào có thể chứa được) và Băng thông bộ nhớ (Memory Bandwidth – mô hình chạy…

So Sánh “Khủng Long” AI: Jetson Thor vs L4/L40S – Khi TFLOPS Không Kể Hết Câu Chuyện

Sự ra mắt của NVIDIA Jetson Thor đã tạo nên một cơn địa chấn trong cộng đồng AI và robotics, với tuyên bố về hiệu suất lên đến 2070 TFLOPS, một con số vốn chỉ thấy ở các hệ thống data center. Điều này không thể không dẫn đến sự so sánh trực tiếp với…

Từ Orin đến Thor: Bước nhảy vọt kiến trúc của NVIDIA JetPack 7.0 và tương lai của robot hình người

Kỷ nguyên mới của Robotics với JetPack 7.0 và Jetson Thor Robot hình người không chỉ là một khái niệm trong các bộ phim khoa học viễn tưởng – nó đã là hiện thực. Các công ty như Boston Dynamics, Tesla Optimus, Figure AI đang xây dựng những con robot này ngay hôm nay. Nhưng…

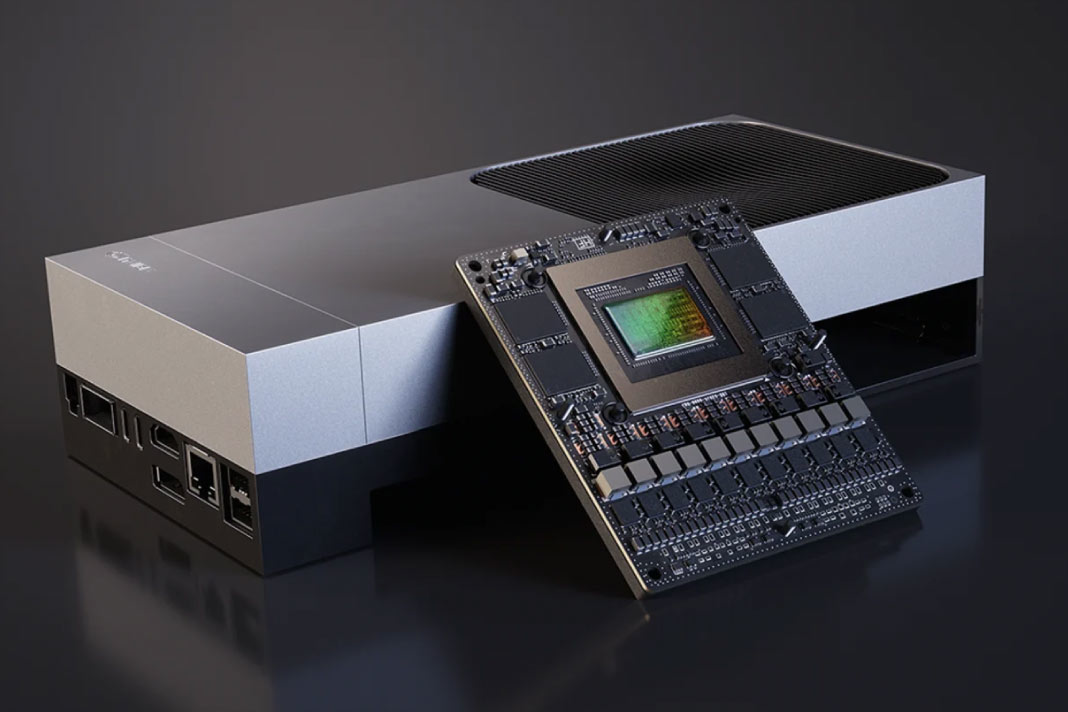

Tại sao gọi NVIDIA DGX Spark là Siêu máy tính AI cá nhân?

Việc ra mắt thế hệ máy tính NVIDIA DGX Spark đánh dấu một bước ngoặt lớn của riêng NVIDIA lẫn cả ngành công nghiệp AI, đưa sức mạnh tính toán cấp độ trung tâm dữ liệu (Data Center) xuống ngay bàn làm việc của các nhà phát triển. Nó được gọi là “siêu máy tính”…

Cơ chế quản lý bộ nhớ trên các nền tảng phần cứng nhất quán – Hardware-coherent

Nếu bạn là nhà phát triển ứng dụng hoặc quản trị viên hệ thống cluster, bạn có thể đã thấy cách mà kiến trúc truy cập bộ nhớ bất đồng dạng – Non-uniform Memory Access (NUMA) – có thể ảnh hưởng đến hiệu suất hệ thống như thế nào. Khi một ứng dụng không hoàn toàn…

ASUS chính thức lên kệ chiếc siêu máy tính AI ASCENT GX10 dựa trên DGX Spark

Thế giới đang bước vào kỷ nguyên Trí tuệ Nhân tạo (AI) với tốc độ chưa từng có, và nhu cầu về sức mạnh tính toán đột phá – đặc biệt là các giải pháp tại chỗ, an toàn và linh hoạt – đang trở nên cần thiết hơn bao giờ hết. Sự ra mắt…

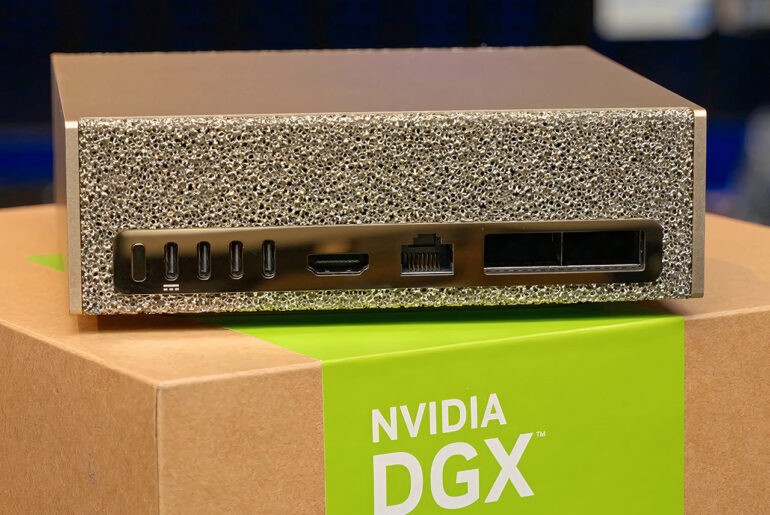

NVIDIA DGX Spark bắt đầu đến tay các nhà phát triển AI trên toàn thế giới

NVIDIA hôm nay đã công bố bắt đầu xuất xưởng NVIDIA DGX Spark, siêu máy tính AI nhỏ nhất thế giới, và giao đến tay khách hàng trên toàn cầu. Các tải công việc AI đang nhanh chóng vượt quá khả năng của bộ nhớ và phần mềm trên PC, máy trạm và máy tính…

QNAP ra mắt Máy chủ Lưu trữ Edge AI: Cuộc cách mạng triển khai trí tuệ nhân tạo tại chỗ cho doanh nghiệp

Khi AI đã trở thành “hơi thở” cần thiết cho mọi lĩnh vực, doanh nghiệp phải đối mặt với nhiều thách thức mới. Những vấn đề nổi bật là hiệu năng xử lý, bảo mật dữ liệu và chi phí vận hành tăng cao. Mặc dù điện toán đám mây được xem là giải pháp tốt,…