-

Server

Hãng sản xuấtTheo cấu hình

Hãng sản xuấtTheo cấu hình -

Workstation

Hãng sản xuấtWorkstation

Hãng sản xuấtWorkstation - Storage

-

Parts

Hãng sản xuấtTheo dòng máy chủ

-

Networking

Hãng sản xuất

Hãng sản xuất - License

- Giải pháp

- Blog

- Thông tin

- Liên hệ

Danh mục

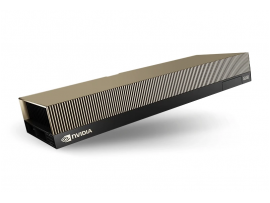

Hệ thống Lưu trữ AI chuyên dụng NVIDIA Groq 3 STX

- Nhà sản xuất: NVIDIA

- Model No. (Chưa có)

- Tình trạng: Vui lòng gọi

Giá bán: Call

NVKD sẽ liên hệ lại ngay

Thông tin sản phẩm Hệ thống Lưu trữ AI chuyên dụng NVIDIA Groq 3 STX

Groq 3 STX là giải pháp lưu trữ dữ liệu (Storage) thế hệ mới, được thiết kế tối ưu để loại bỏ các nút thắt cổ chai về dữ liệu trong các hệ thống suy luận AI quy mô lớn. Với kiến trúc STX, Groq cung cấp khả năng truy xuất dữ liệu mô hình và dữ liệu ngữ cảnh (Context) với độ trễ gần như bằng không, đảm bảo các LPU™ luôn hoạt động ở hiệu suất tối đa.

Hiệu suất lưu trữ đột phá:

Tối ưu hóa cho AI Inference: Thiết kế chuyên biệt để phục vụ việc tải các mô hình ngôn ngữ lớn (LLM) và truy xuất nhanh các cơ sở dữ liệu vector (RAG - Retrieval-Augmented Generation).

Băng thông vượt trội: Hỗ trợ giao tiếp NVMe Gen 6/Gen 5, cung cấp tốc độ đọc/ghi dữ liệu liên tục lên đến hàng trăm GB/s, đáp ứng nhu cầu của các Agentic AI hoạt động liên tục.

Độ trễ cực thấp (Ultra-low Latency): Công nghệ Direct-to-LPU giúp dữ liệu đi thẳng từ bộ lưu trữ vào chip xử lý mà không cần thông qua CPU quá nhiều, giảm 40% độ trễ so với các hệ thống lưu trữ truyền thống.

Công nghệ kết nối hiện đại:

Hỗ trợ GroqFabric: Khả năng kết nối mạng lưu trữ tốc độ cao, cho phép chia sẻ dữ liệu mượt mà giữa hàng nghìn card Groq 3 LPX trong cùng một cụm (Cluster).

Chuẩn kết nối STX: Kiến trúc lưu trữ mở rộng (Scalable Storage) cho phép doanh nghiệp nâng cấp dung lượng và băng thông một cách độc lập tùy theo quy mô của mô hình AI.

Tương thích hoàn hảo với ConnectX-9: Tích hợp sâu với các card mạng 800 Gb/s để đảm bảo việc di chuyển dữ liệu giữa các node diễn ra tức thì.

Hiệu quả vận hành và Tin cậy:

Thiết kế mật độ cao: Tối ưu hóa không gian tủ rack, cung cấp dung lượng lưu trữ khổng lồ trong một thiết kế nhỏ gọn, giúp giảm chi phí hạ tầng trung tâm dữ liệu.

Bảo mật dữ liệu cấp doanh nghiệp: Tích hợp mã hóa phần cứng và các tính năng bảo vệ dữ liệu tiên tiến, đảm bảo an toàn cho các dữ liệu nhạy cảm của AI.

Khả năng tự hồi phục: Hệ thống quản lý thông minh tự động phát hiện và khắc phục các lỗi lưu trữ nhỏ mà không làm gián đoạn quá trình suy luận của AI.

Xem thêm

Sản phẩm liên quan(4)

Copyright © 2025 thegioimaychu.vn. All Rights Reserved.

-600x451.jpg)